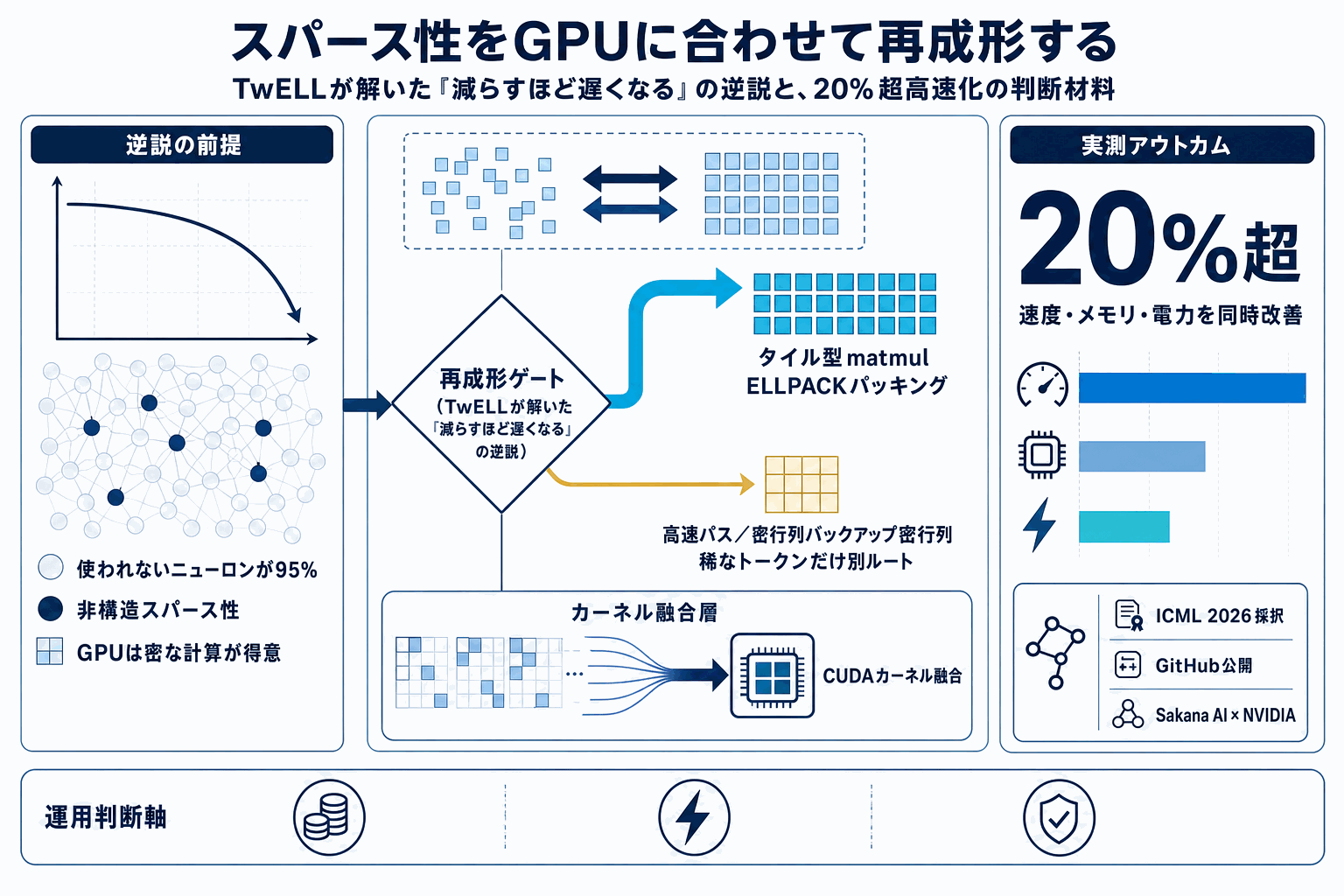

Sakana AIとNVIDIAの共同研究「Sparser, Faster, Lighter Transformer Language Models」は、LLMのフィードフォワード層で95%以上のニューロンが任意のトークンに対して不活性であるという事実を出発点としている。人間の脳が必要なニューロンだけを活性化させるように、LLMも本質的にスパースに振る舞う。しかし、既存のGPUは密な行列演算を前提に設計されており、非構造的なスパース性は不規則なメモリアクセスを生み、結果として「計算量を減らすほど遅くなる」という逆説を生んでいた。

研究チームは「GPUをスパース性に合わせる」のではなく「スパース性をGPUに合わせて再成形する」というアプローチを採った。中核技術のTwELL(Tile-wise ELLPACK)は、既存の最適化されたタイル型matmulカーネルに直接統合できるパッキング形式で、99%の高スパーストークンを高速パスに、稀に現れる高密度トークンを密行列バックアップに動的にルーティングするハイブリッド構造を持つ。

加えて、複数のスパース行列積を融合するカスタムCUDAカーネルを開発し、スループット最大化と活性化サイズ圧縮を同時に実現した。10億パラメータ規模のスパースLLMの学習・推論で20%超の速度向上と、それ以上のピークメモリ・エネルギー削減を実測している。

成果はICML 2026で発表予定で、論文・技術ブログ・実装コードがすべて公開されている。推論コストと消費電力がAI事業の主要コスト要因となる中、既存のGPUインフラ上で即座に検証できるオープンソース実装は、運用側の意思決定材料として実用価値が高い。