Diffuman4Dは、浙江大学のZJU3DVグループが公開した、スパース視点動画から4D一貫性を保った人体自由視点映像を生成する時空間拡散モデルである。ICCV 2025採択論文の実装として、GitHubに推論コード、Hugging Face『krahets/Diffuman4D』に学習済みモデル、さらに再アノテーション済みDNA-Renderingデータセットがそれぞれ公開された。

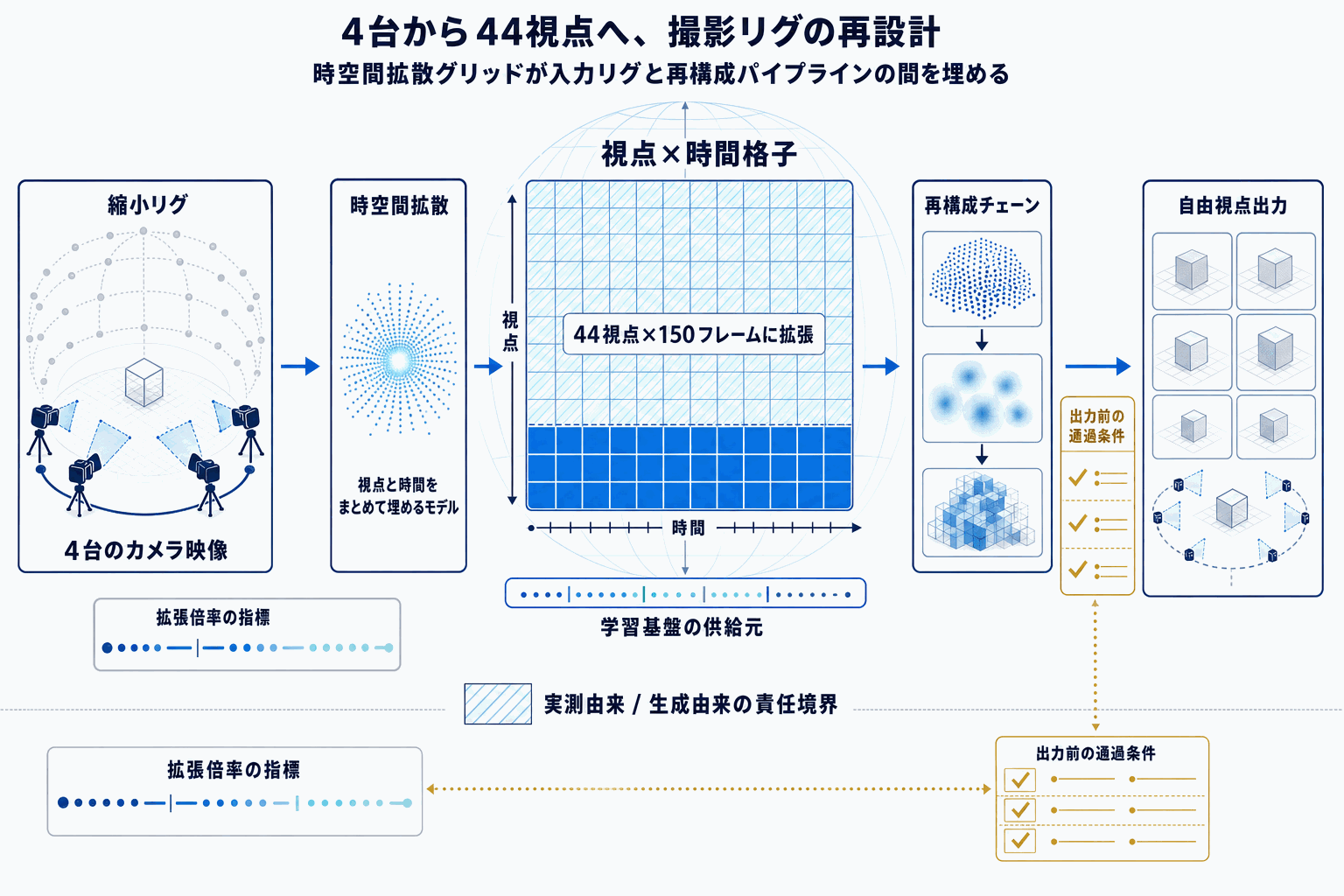

技術的な核は、4台程度のカメラ映像を入力として、最大44視点×150フレームに及ぶ4D画像グリッドを生成できる点にある。視点方向と時間方向の整合性を1つの拡散モデルで同時に扱う設計のため、出力された多視点動画をそのまま3DGS/4DGS再構成に流し込めば、nerfstudio経由で自由視点レンダリングまで一気通貫で検証できる。リポジトリにはSapiensによるキーポイント推定、骨格三角測量、前景マスク予測といったカスタムデータ処理スクリプトも同梱されており、自前撮影素材を投入する敷居が低い。

配布されるDNA-Rendering処理済みデータは、48カメラ・最大225フレーム・1000件超のシーケンスで計約1000万枚規模に達する。これは人体多視点研究のベンチマーク基盤として大きく、後続のアバター生成・ボリュメトリックビデオ研究の比較土台になる。

意思決定の観点では、48台規模のボリュメトリックスタジオを前提としていた制作工程に、4台撮影+生成補完という選択肢が加わった意味が大きい。映像制作・スポーツ中継・XRコンテンツの企画段階で、撮影コストと出力品質のトレードオフを再設計できる。一方で、実在人物の多視点合成が容易になることで、肖像権・出演契約上の利用範囲定義が現場の優先課題として浮上する。