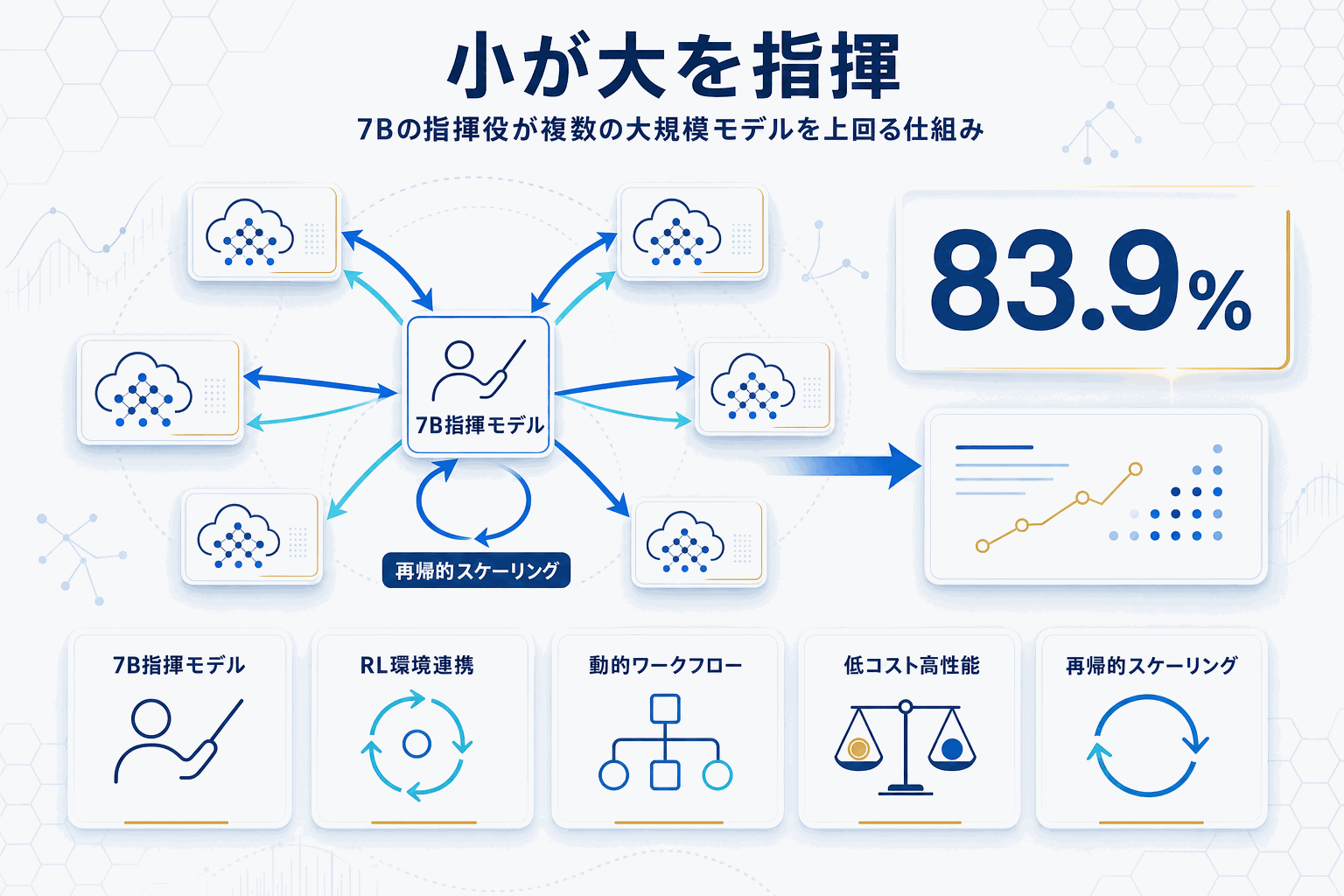

Sakana AIが公開した『Learning to Orchestrate Agents in Natural Language with the Conductor』は、AIを直接問題解決にあてるのではなく、他のAIに仕事を委譲する「マネージャー」として訓練した研究である。7BパラメータのConductorモデルを強化学習でエンドツーエンドに訓練し、GPT-5・Gemini・Claudeおよびオープンソースモデルを含むプールを指揮させた。

Conductorはコードを実行するのではなく、自然言語で「どのエージェントを呼ぶか」「どのサブタスクを与えるか」「過去のどのメッセージを文脈に渡すか」を指定するワークフローを出力する。報酬最大化のみから、単純な事実質問は1回の問い合わせで済ませ、難しいコーディング問題ではプランナー・実行役・検証役のパイプラインを自律的に組み上げる挙動が現れた。

結果として、7BのConductorはプール内のどの個別モデルよりも高い性能を示し、発表時点でLiveCodeBench 83.9%・GPQA-Diamond 87.5%を記録した。Mixture-of-Agentsのような高コストなマルチエージェントベースラインも、わずかなコストで上回った。さらにConductorが自分自身をワーカーとして選ぶ『再帰的テスト時スケーリング』により、前の出力を読み直して修正ワークフローを組み直す動作が可能で、推論時計算のスケーリング軸が増えた。

本研究はICLR2026に採択され、同社の新マルチエージェントシステム『Sakana Fugu』の基盤技術として既に組み込まれている。読者にとっての含意は明確で、マルチエージェントを設計する際、固定ワークフローや単純ルーターではなく、学習された指揮役を置く選択肢が数値根拠付きで増えた。