OpenAIは2026年5月5日、大規模AI訓練向けの新ネットワークプロトコル「MRC(Multipath Reliable Connection)」を公開した。Open Compute Project(OCP)を通じてオープン仕様として提供される点が最大の特徴で、同日にAMDが対応ブログを公開し、同日のトレンドではNVIDIAのSpectrum-XもMRC対応を打ち出している。

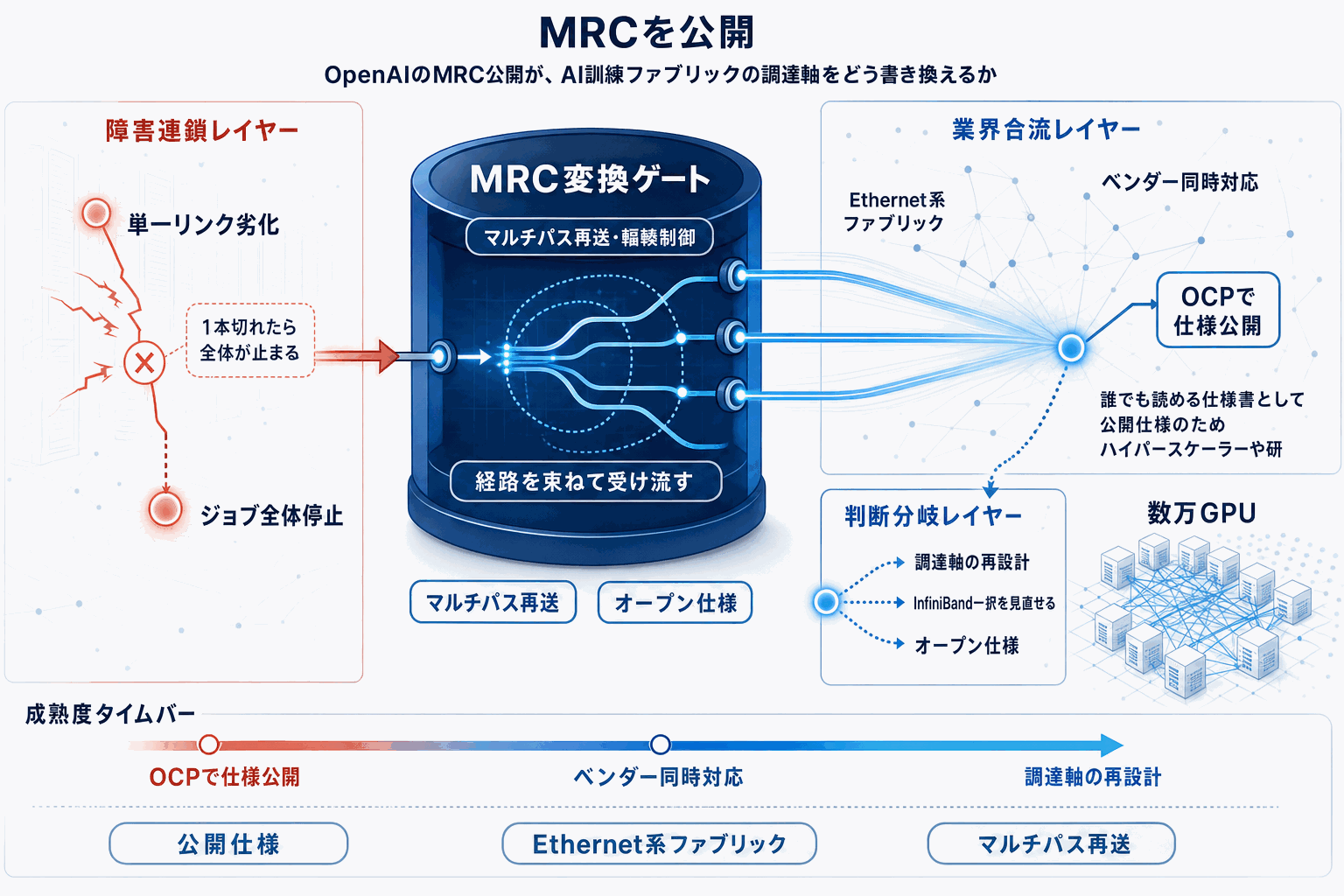

背景には、GPU数万台規模の訓練ジョブにおけるネットワーク障害の影響の大きさがある。従来のRDMA/RoCE構成では単一リンクの劣化がジョブ全体のスループットを直撃し、チェックポイントからの再開コストが無視できない規模に膨らむ。MRCはマルチパスを前提に再送・輻輳制御を設計することで、この弱点を構造的に解消しにいくアプローチだ。

日本の意思決定者にとっての含意は3つある。第一に、AIインフラ調達でInfiniBand以外の現実的な選択肢が増えたこと。AMDとNVIDIAの双方がEthernet側で対応を進めるため、単一ベンダー前提の設計を見直す素材になる。第二に、OCP準拠という調達要件を立てられるようになり、政府系・大手企業のAI基盤仕様に反映しやすくなる。第三に、MLエンジニア視点では、訓練ジョブの障害復旧時間や有効スループットを改善する具体策として検証対象に入る。

注意点として、現時点では仕様公開と主要ベンダーの対応表明の段階であり、本番運用での性能差や実装成熟度は各社の実機検証を待つ必要がある。既存クラスターへの後付け適用可否、NIC・スイッチの世代要件、運用ツールチェーンとの整合は、仕様書を読み込んで切り分けるべき論点だ。