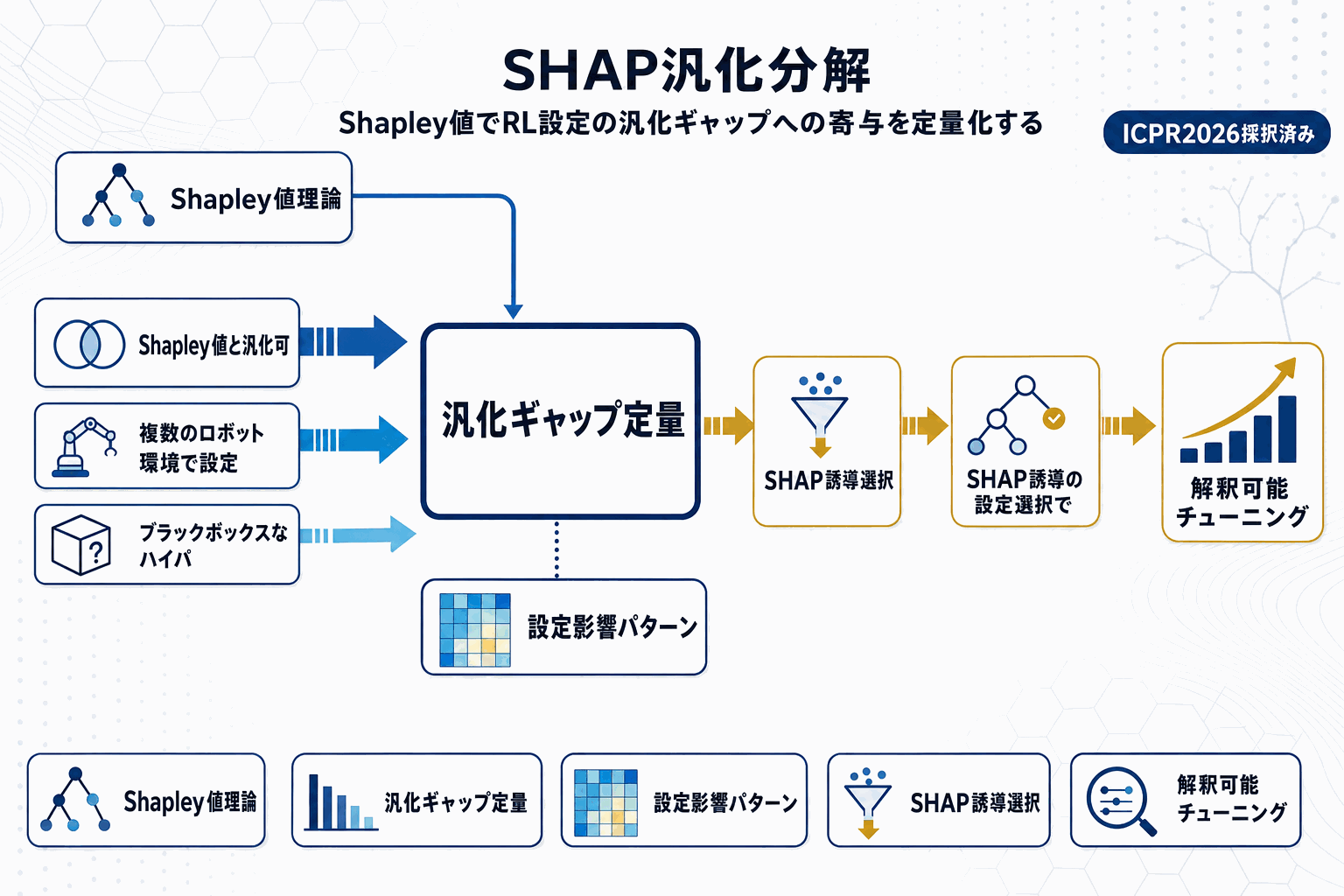

強化学習(RL)はアルゴリズムやハイパーパラメータの選択に性能が強く依存し、環境を変えると汎化ギャップが顕在化する。これが実機ロボットへの展開を難しくしてきた。今回arXivに公開された論文「Enhancing RL Generalizability in Robotics through SHAP Analysis of Algorithms and Hyperparameters」は、この課題に対してSHapley Additive exPlanations(SHAP)を適用し、各設定が汎化ギャップにどれだけ寄与するかを定量的に分解する枠組みを提案している。

論文の貢献は三点に整理できる。第一に、Shapley値と汎化可能性を結びつける理論的基盤を示した点。第二に、複数のロボット環境で設定の影響パターンを実証的に分析し、タスクや環境が変わっても一貫した傾向があることを確認した点。第三に、その知見を設定選択に戻す「SHAP誘導の設定選択」を導入し、汎化性能の改善を達成した点である。

実務への含意は明確だ。これまでハイパーパラメータ探索は全探索やベイズ最適化に頼ることが多く、どの設定がなぜ効いたのかを説明しにくかった。SHAPによる寄与分解を挟むことで、探索の優先順位づけが根拠とともに示せるようになる。ロボットの産業応用ではsim-to-realのチューニング工数が導入コストを押し上げてきたため、この工数を削る技術的な選択肢が増えることになる。

なお、論文はICPR 2026に採択済みで、15ページ・7図構成。日本の開発現場で採用する際は、対象アルゴリズムと環境が自社のスタックと重なるかを確認し、まずは主要ハイパラに絞ってSHAP寄与を測るところから切り分けるのが現実的だろう。