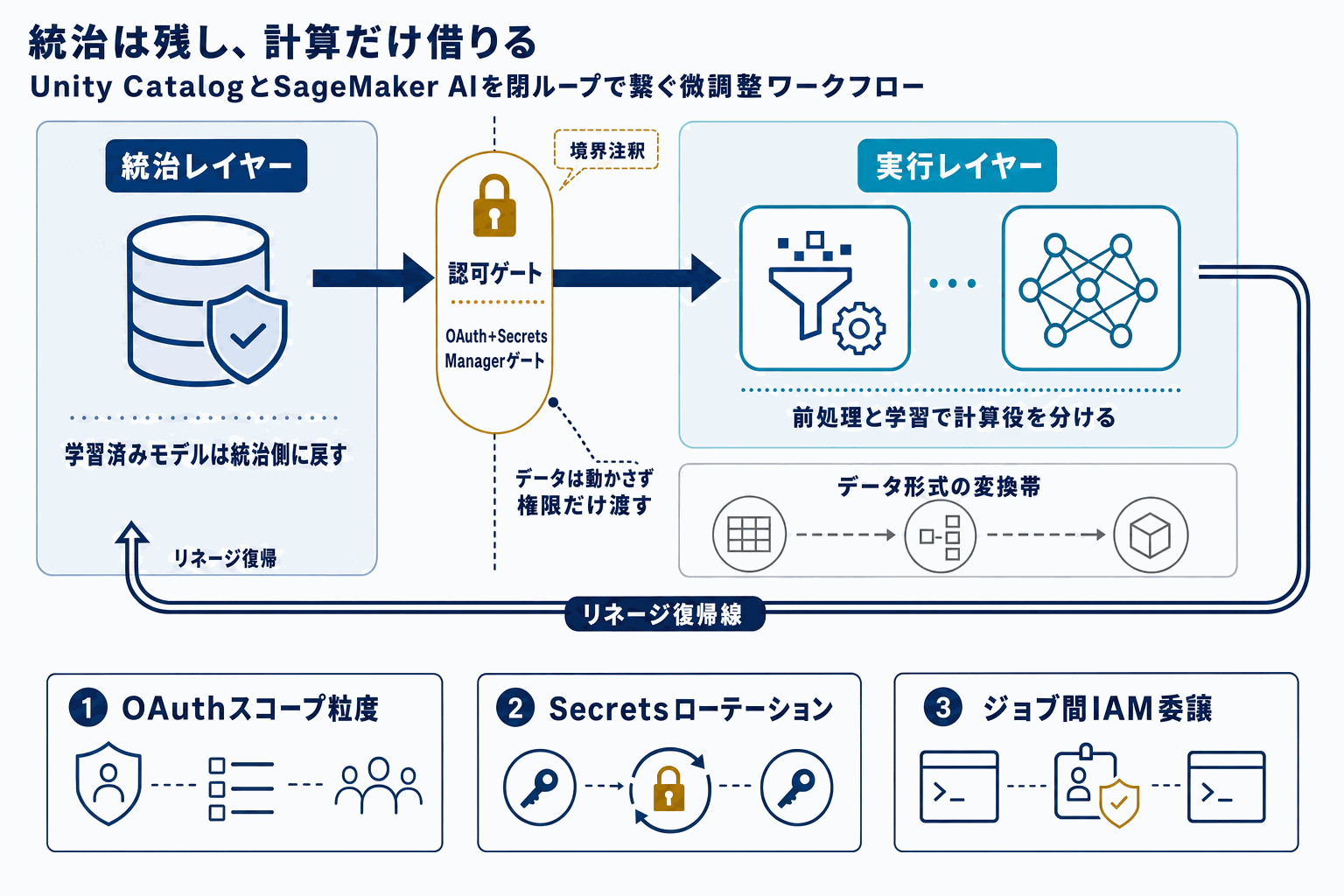

AWSが公開した本実装は、Databricks Unity CatalogとAmazon SageMaker AIを橋渡しし、ガバナンス済みデータを使ったLLMファインチューニングを単一ワークフローで完結させる構成を示している。

中核となるのはUnity CatalogのOpen REST APIとOAuth認証だ。DatabricksのOAuthクライアントID/シークレットをAWS Secrets Managerで管理し、Amazon EMR Serverless上のApache SparkがUnity Catalog経由でS3上の管理データへ安全にアクセスする。学習データにはSEC EDGARに公開されているS&P 500企業の2023〜2024年の10-K・10-Qからリスクファクターセクションを抽出し、Sparkで整形する。

ファインチューニング対象はMistral AIのMinistral-3-3B-Instructで、Hugging FaceからモデルウェイトをSageMaker AIへロードし学習を実行する。学習済みアーティファクトはUnity Catalog管理のS3バケットへ書き戻され、Unity Catalogにモデル登録と外部データリネージが作成される。これにより、どの開示文書がどのモデルの学習に使われたかが監査可能な形で残る。

読者にとっての価値は、DatabricksとAWSのいずれかへ寄せる必要なく既存資産を活かせる点にある。Unity Catalogでデータを統治しつつ、SageMaker AIで学習リソースを確保する併用構成が公式手順として揃ったことで、規制産業のMLOpsチームは権限境界とリネージを崩さず軽量LLMの内製化に着手しやすくなる。実装着手時の落とし穴としては、OAuthスコープの粒度設計、Secrets Managerのローテーション運用、EMR ServerlessとSageMakerジョブ間のIAM委譲設計を初期段階で詰めておかないと、後から監査要件と衝突する点に注意したい。なお具体的な学習時間・コストの公開数値はソースに記載がない。