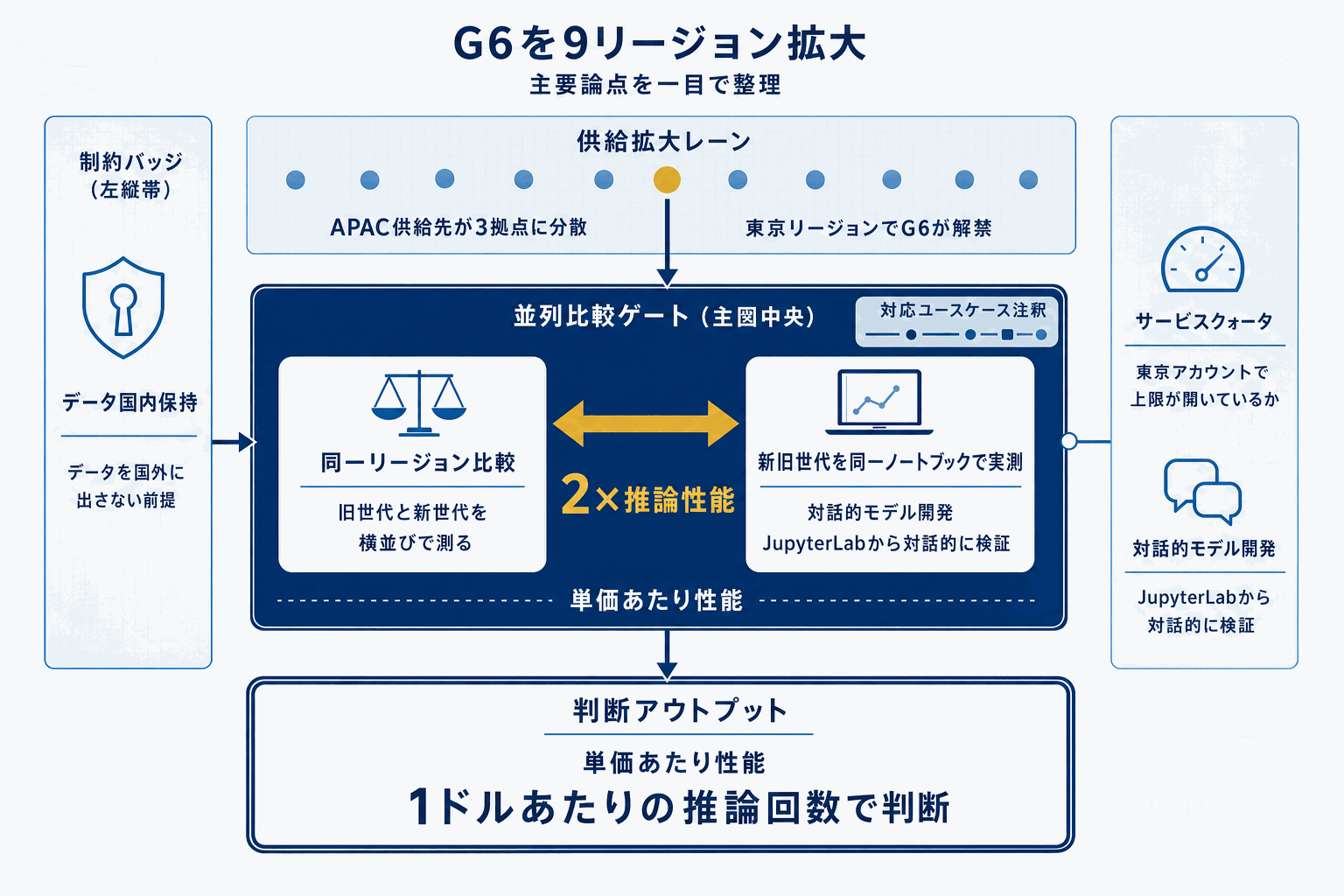

AWSは2026年5月12日、SageMakerノートブックインスタンスにおけるAmazon EC2 G6の一般提供を、アジアパシフィックの東京・ムンバイ・シドニーと、欧州のロンドン・パリ・フランクフルト・ストックホルム・チューリッヒへ拡大したと発表した。G6はNVIDIA L4 Tensor Core GPUを最大8基搭載し、GPUあたり24GBのメモリと第3世代AMD EPYCプロセッサを組み合わせる構成で、ディープラーニング推論性能はG4dn比で2倍とされている。

日本の開発現場にとって直接的に効くのは、東京リージョンでL4世代のGPUがSageMakerノートブック上から利用可能になった点だ。これまでG4dn(T4世代)で推論検証を行っていたチームは、同一リージョン内で旧世代と新世代を並べて比較でき、移行判断に必要なベンチマークをデータ越境なしに取得できる。個人情報保護法や金融・医療系ガイドラインで国内保持が前提となるデータについても、検証段階からGPUを当てやすくなった。

対応ユースケースとしてAWSは、生成AIのファインチューニングと推論、自然言語処理、言語翻訳、コンピュータビジョン、レコメンダーエンジンを挙げている。SageMaker StudioのJupyterLabおよびCodeEditorアプリケーションからも起動できるため、対話的なモデル開発フローに組み込みやすい。

読者がまず行うべきは、対象アカウントでG6系インスタンスのサービスクォータが東京リージョンで開いているかの確認と、既存のG4dnジョブをG6で再計測した上での単価あたり性能の比較である。公開された価格は本発表に含まれないため、移行ROIは自社実測値で詰める必要がある。