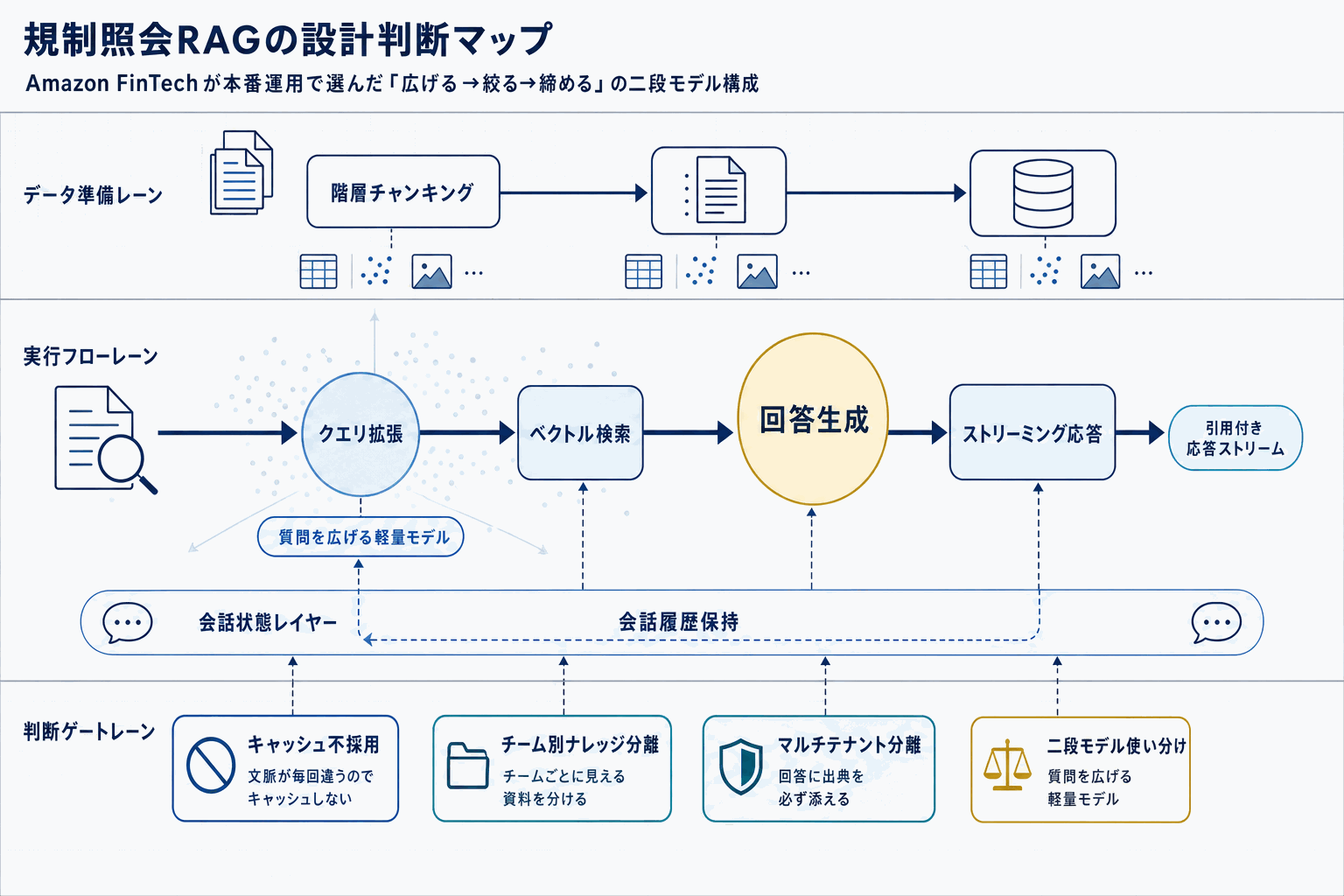

AWS Machine Learning Blogが2026年5月13日に公開した本記事は、Amazon FinTechチームが規制当局からの照会対応業務に生成AIを本番投入している構成を明らかにしたものだ。各チームが自分たちの文書・参考資料で構築する専用ナレッジベースを持ち、Amazon Bedrock Knowledge BasesとOpenSearch Serverlessによってベクトル検索を提供する。

注目すべきはモデルの使い分けだ。クエリ拡張には軽量・低遅延のClaude 3.5 Haikuを充て、最終的な回答生成には精度を要するClaude Sonnet 4.5を使う。文書側の前処理にはAmazon Bedrock Data Automation(BDA)を採用し、画像・グラフ・表を含むマルチモーダル文書を事前変換なしで取り込めるようにしている。会話の文脈はDynamoDBで保持し、ユーザー体験はWebSocketストリーミングでリアルタイム化する。

設計判断として興味深いのは、LLMレスポンスのキャッシュを行わない選択だ。規制照会は質問の文脈依存性が高くキャッシュヒット率が低いため、コスト最適化よりも回答の文脈整合性を優先した。

日本の金融・保険・証券・法務部門にとって、この事例は具体的な比較材料になる。金融庁検査対応や社内コンプライアンス照会など、間違いが許されない業務にRAGを適用する際、Amazon自身の本番事例として稟議資料に引用できる。一方で、日本固有の規制(個人情報保護法、金商法等)への適用には、ソース文書の管理体制とチーム別ナレッジベース分離の運用設計を別途定義する必要がある。汎用検索SaaSやオンプレ検索基盤に対しては、クラウド標準コンポーネントだけで同等構成が組めることが示され、選定基準の見直しを迫る材料となる。