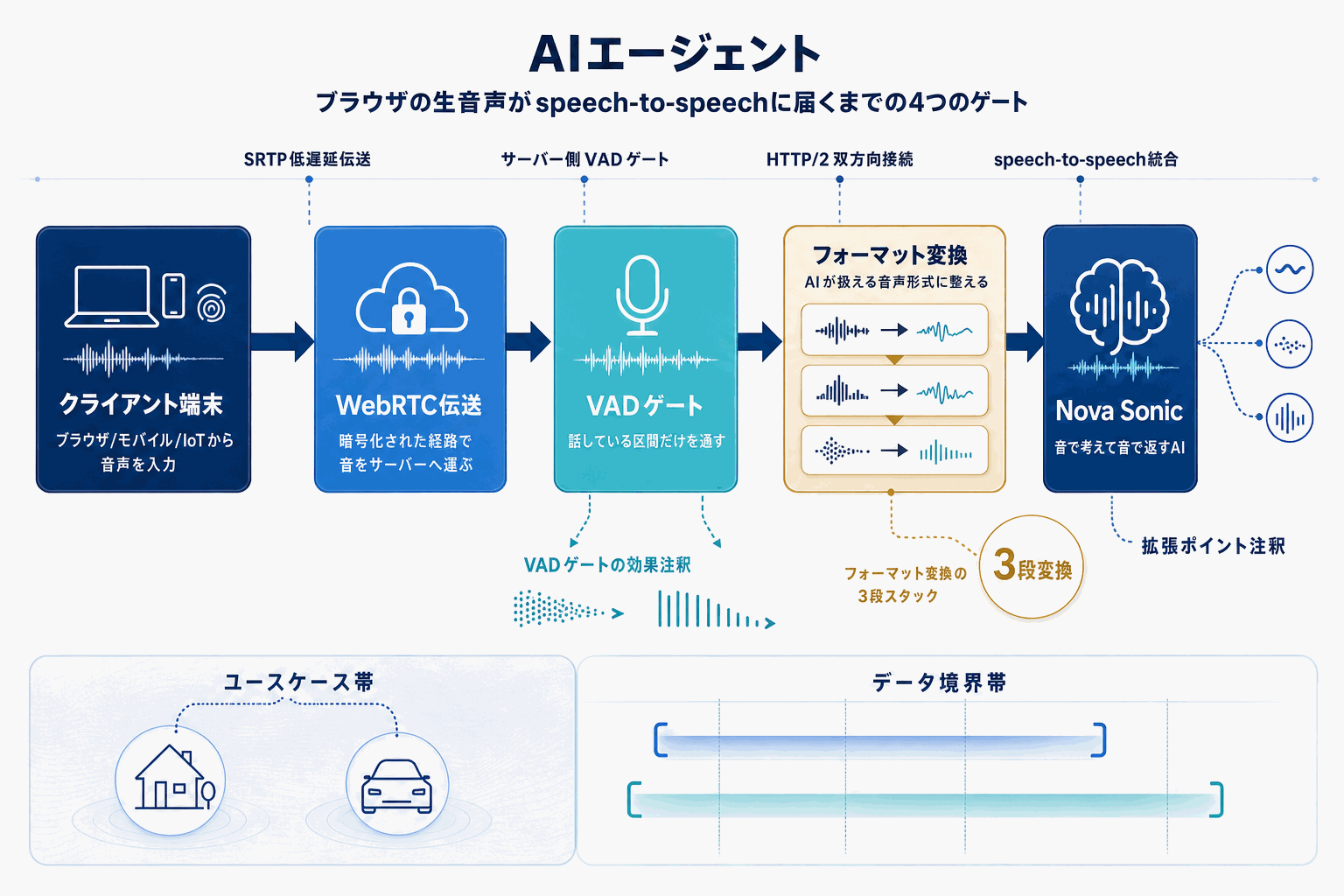

AWSは2026年5月14日、機械学習ブログでAmazon Nova 2 SonicとAmazon Kinesis Video Streams WebRTCを組み合わせたリアルタイム音声ストリーミングアプリの構築手順を公開した。Nova Sonicはspeech-to-speechの統合モデルで、テキスト変換を介さずに音声入出力を扱い、HTTP/2の双方向ストリーミングで接続する。

記事ではWebRTCをトランスポートに据えるアーキテクチャが示されている。クライアントはSRTPで音声を送出し、サーバー側でVAD(音声区間検出)を適用してから Nova Sonicへ流すことで、無音区間の不要なトークン消費とノイズによる誤認識を抑える設計になっている。VADはWebRTCVAD、Silero VAD、Pyannote VADの3種が選択肢として提示され、Python側のWebRTC実装にはaiortcが用いられる。

音声フォーマット面では、ブラウザ由来のステレオ・48kHz・Int16の信号を、モノラル・16kHz・Float32へ3段階で変換する必要がある点が明記されている。サンプリングレート変換はそのままでは認識精度に影響するため、サンプルコードのAudioDataAdaptionドキュメントが参照ポイントになる。

実装サンプルとして、スマートホーム制御とコネクテッドビークル向けの2シナリオがGitHubで公開されている。前者はAWS IoT Core向けのMCPサーバーと連携し、後者は車載UXを想定する。RAGやStrands Agentsとのツール連携も示されており、ドメイン知識の注入や複数ツール呼び出しを伴うエンタープライズ用途への拡張パスが確認できる。日本の開発現場にとっては、ブラウザ・モバイル・IoT機器をまたぐ音声体験を、AWSスタック内で一貫して構築できる参照実装が増えた意味を持つ。