AWSは2026年5月7日、NVIDIA Blackwell GPUを搭載したAmazon EC2 P6-B200インスタンスをAWS GovCloud(US-West)リージョンで一般提供した。GovCloudは米政府機関および規制産業向けに運用される隔離リージョンで、最新GPU世代の投入は通常コマーシャルリージョンより遅れる。今回の提供開始により、FedRAMP High等のコンプライアンス要件下でもBlackwell世代のAI基盤が選択肢に入った。

スペック面ではp6-b200.48xlargeサイズで、8基のBlackwell GPU、合計1440GBの高帯域GPUメモリ、第5世代Intel Xeon(Emerald Rapids)、最大3.2Tbps のEFAv4ネットワークを備える。AWSはP5enインスタンス比でAI学習・推論性能が最大2倍、GPUメモリ帯域幅が60%増と公表している。Nitro Systemによるハードウェア分離とUltraClusters構成で、数万GPU規模までの水平展開が可能とされる。

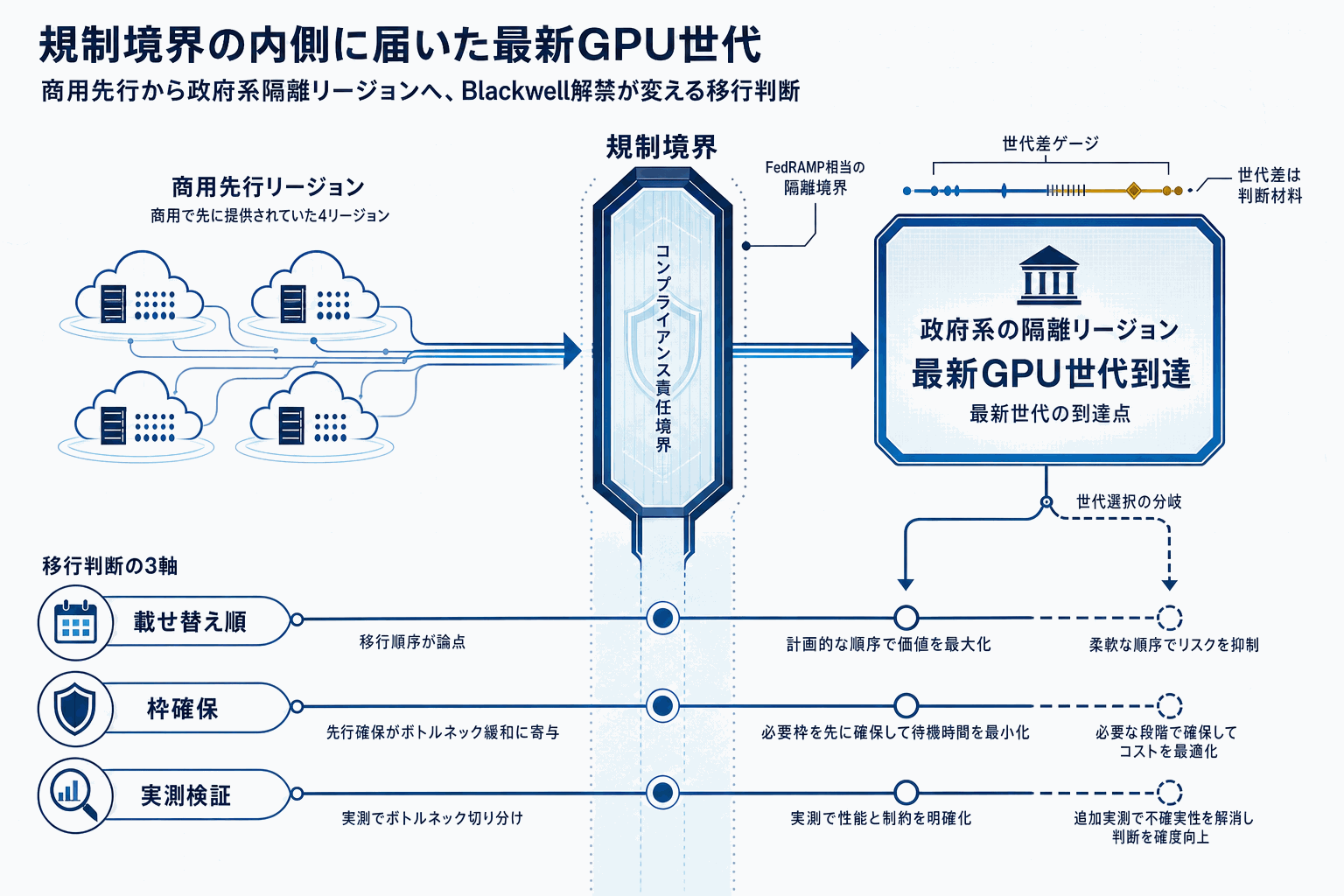

提供リージョンはUS West(Oregon)、US East(N. Virginia、Ohio)、そして今回加わったAWS GovCloud(US-West)の4箇所。日本リージョンは対象外であり、日本国内の企業・官公庁が直接利用する経路ではない。ただし、米政府案件に関与する日本企業、ソブリンクラウドや政府系AI基盤の要件定義を進める事業者にとっては、政府系クラウドでのGPU世代更新のペースを測る参照点になる。

実務上の焦点は、P5en運用中のワークロードをP6-B200にどの順序で載せ替えるか、Capacity Blocks for ML等での枠確保、単位コストあたりのスループット改善幅の実測になる。ベンダー公表値と実測値の差分を記録し、既存パイプラインのボトルネックがGPU計算か、メモリ帯域か、ネットワークかを切り分ける作業が、移行判断の前提になる。