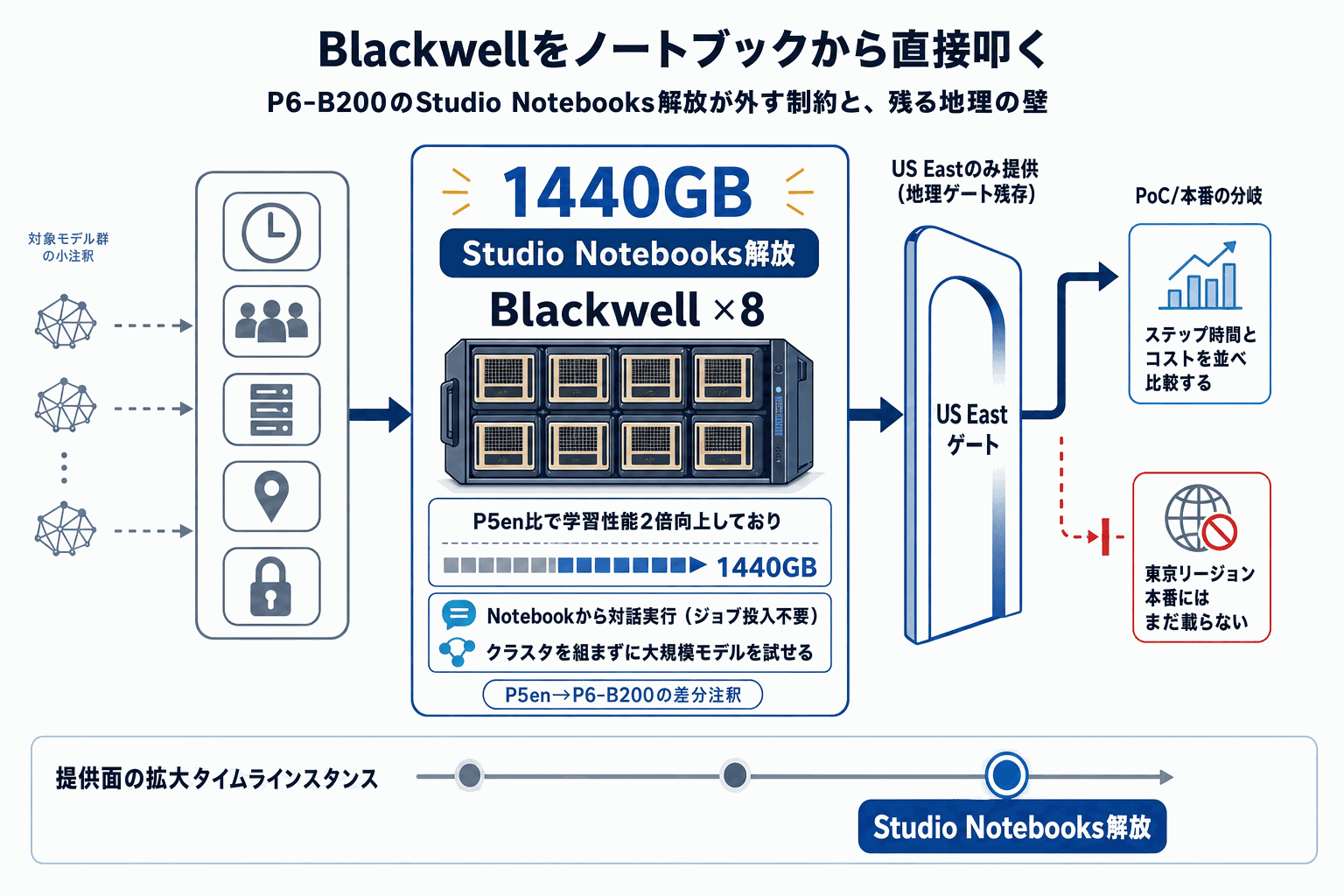

AWSはAmazon EC2 P6-B200インスタンスを、SageMaker Studio NotebooksのUS East(バージニア北部)リージョンで一般提供開始した。P6-B200は、NVIDIA Blackwell GPUを8基、合計1440GBの高帯域幅GPUメモリ、第5世代Intel Xeonプロセッサ(Emerald Rapids)を搭載する構成で、AIトレーニング性能はP5en比で最大2倍とされている。

今回のポイントは、提供形態がSageMaker Studio Notebooks、すなわちJupyterLabおよびCodeEditor環境からの対話的利用である点だ。これまでP6-B200はSageMaker HyperPodやTraining Jobsでの提供が先行していたが、ノートブック窓口が開いたことで、開発者は専用クラスタを組まずに大規模モデルの試作・ファインチューニングをそのままインタラクティブに回せる。LLM、Mixture of Experts、マルチモーダル推論モデルが対象として明示されており、エンタープライズコパイロットやテキスト・画像・動画の生成系アプリケーションを想定した位置づけになっている。

日本企業の意思決定への翻訳としては、提供がUS Eastに限定される点を踏まえる必要がある。東京リージョン前提の本番構成にはまだ取り込めないが、研究開発・PoC段階のファインチューニング基盤としては、1440GBのGPUメモリと2倍の学習性能というスペック差は無視できない。既存のP5en/P5でのジョブをそのままP6-B200に載せ替え、ステップ時間とコストを比較するベンチマーク作業が、当面の最初の一手になる。