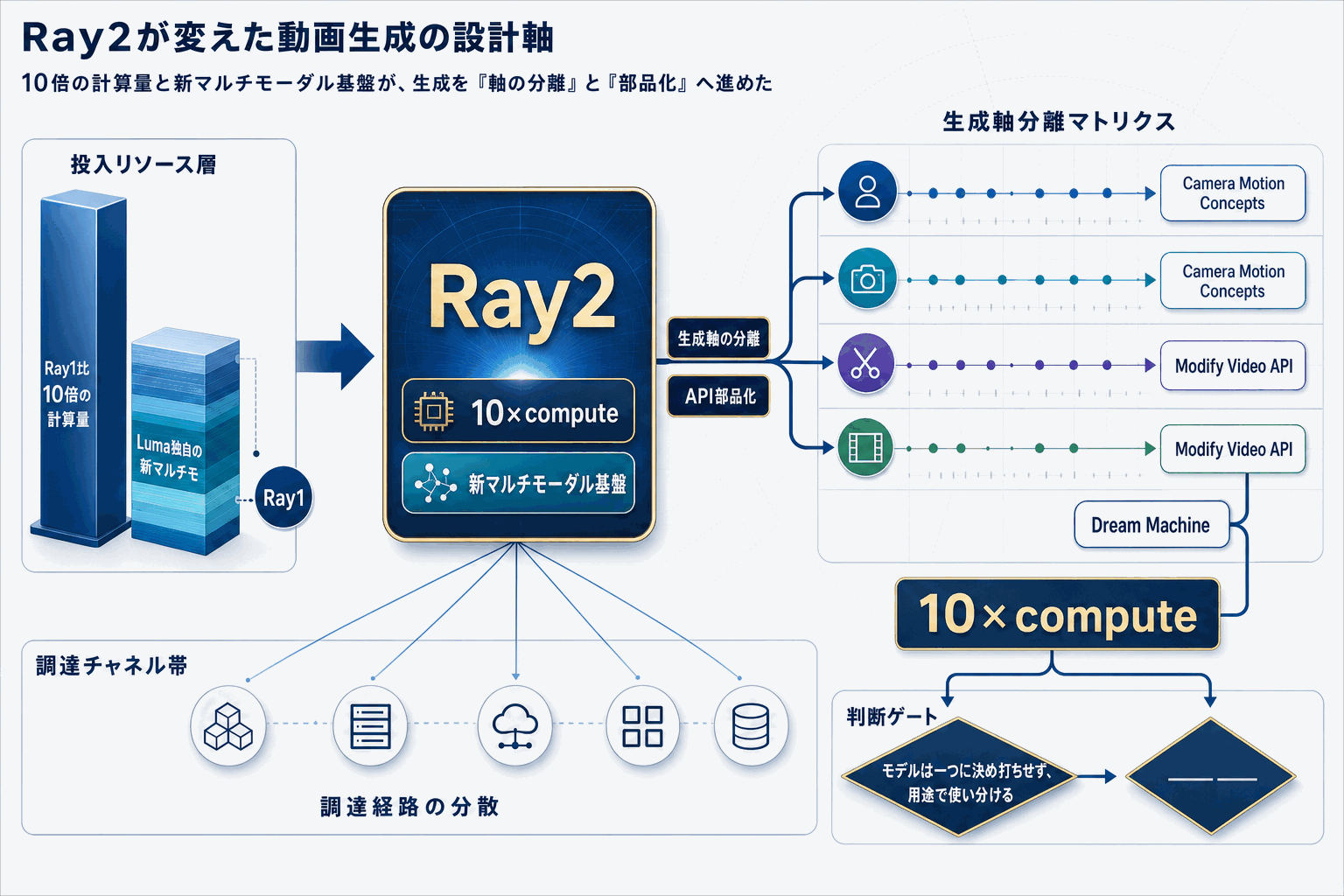

Luma Labsが公開したチェンジログ「Introducing Ray2」は、同社のAI動画生成モデルの世代交代を告げる発表である。公式記述によれば、Ray2は新しいマルチモーダルアーキテクチャの上に構築され、前世代Ray1の10倍の計算量が投じられている。Luma自身はこれを「動画生成技術の新時代の幕開け」と位置づけている。

注目すべきはリリース単発で終わっていない点である。2025年3月にはRay2向けにCamera Motion Conceptsが追加され、学習可能なカメラモーション制御という形で「被写体の生成」と「カメラワークの指定」を分離する方向に進んだ。2025年6月にはModify Video APIが公開され、開発者がプログラムから動画変換を大規模に実行できるようになった。これにより、Ray2はWebのDream Machine UIの中だけで使うツールから、他社プロダクトのパイプラインに組み込める部品に性格を変えている。

日本の実装現場にとっての含意は二つある。第一に、動画生成モデルの選定が「単一モデルで決め打ち」から「用途別に複数モデルを併用」へ移行している点。Ray2はReplicate、AI/ML API、Segmind、Polloなど複数の代理プラットフォーム経由でも提供されており、調達経路は分散している。自社のユースケース(広告素材、プロトタイプ映像、教育コンテンツ等)ごとにRay2の出力特性を実測し、Sora系や他モデルと比較する工程が必要になる。

第二に、Modify Video APIは既存動画を入力とするため、入力素材の権利処理と出力の利用範囲を社内ルールで先に切り分ける必要がある。規制より先に利用規約とワークフロー整備が問われる局面に入っている。