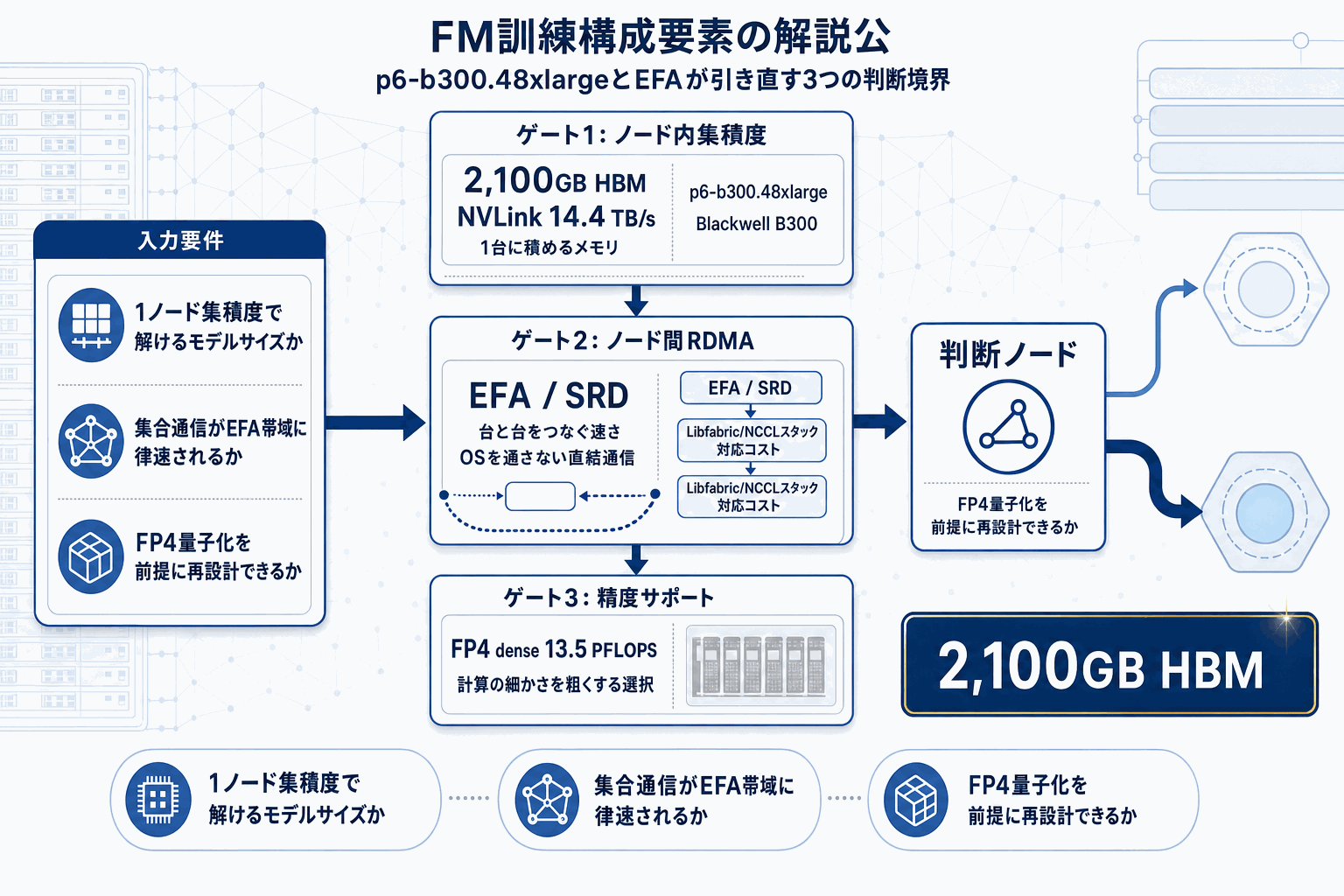

Hugging Face Blogに公開された本記事は、AWS上でファンデーションモデルを訓練・推論する際に必要となる構成要素を、GPUインスタンス・ネットワーク・ソフトウェアスタックの3層で整理している。読者が最も注目すべきは、p6-b300.48xlarge(B300 GPU×8搭載)の仕様だ。HBM容量2,100GB、NVLink帯域14.4TB/s、EFA帯域800GB/sという数値は現行EC2インスタンスで最大であり、1ノードあたりの集積度がBlackwell世代で大きく更新されたことを示す。

精度面ではB200で9 PFLOPS、B300で13.5 PFLOPSのFP4 dense Tensor演算がサポートされる。これはH100/H200世代にはなかった精度であり、低精度量子化を活用する推論サービングにおいてコスト境界が動く要素となる。FP4が利用できる前提でモデル設計・量子化パイプラインを再構築するか否かが、次の実装判断のポイントになる。

ネットワーク層ではEFA(Elastic Fabric Adapter)の役割が強調されている。SRD(Scalable Reliable Datagram)プロトコルによるOS-bypass RDMAをLibfabric API経由で提供し、カーネルを介さずネットワークデバイスと直接通信することでレイテンシを削減する。大規模分散学習における集合通信のボトルネックを回避するための技術的根拠として、aws-ofi-nccl経由でのNCCL統合と組み合わせた設計が前提となる。

日本の開発現場への含意は明確だ。自社でDGX級ハードウェアを調達せずとも、p6-b300を従量課金で利用すればBlackwell世代へのアクセスが可能になる。一方で、FP4対応・EFA最適化・Libfabricスタックの理解が前提となるため、既存のH100ワークロードをそのまま移植するのではなく、精度とネットワーク設計の再評価が必要になる。