EU AI法は2025年8月2日に施行され、汎用AIモデル(GPAI)プロバイダーには透明性確保や著作権遵守などの義務が課されている。ファインチューニングを行う組織も、追加学習のFLOPs(浮動小数点演算回数)が一定の閾値を超えるとGPAIプロバイダーとしての完全な義務が発生する仕組みになっており、自社が義務対象に該当するかの判定そのものが実務上の課題となっていた。

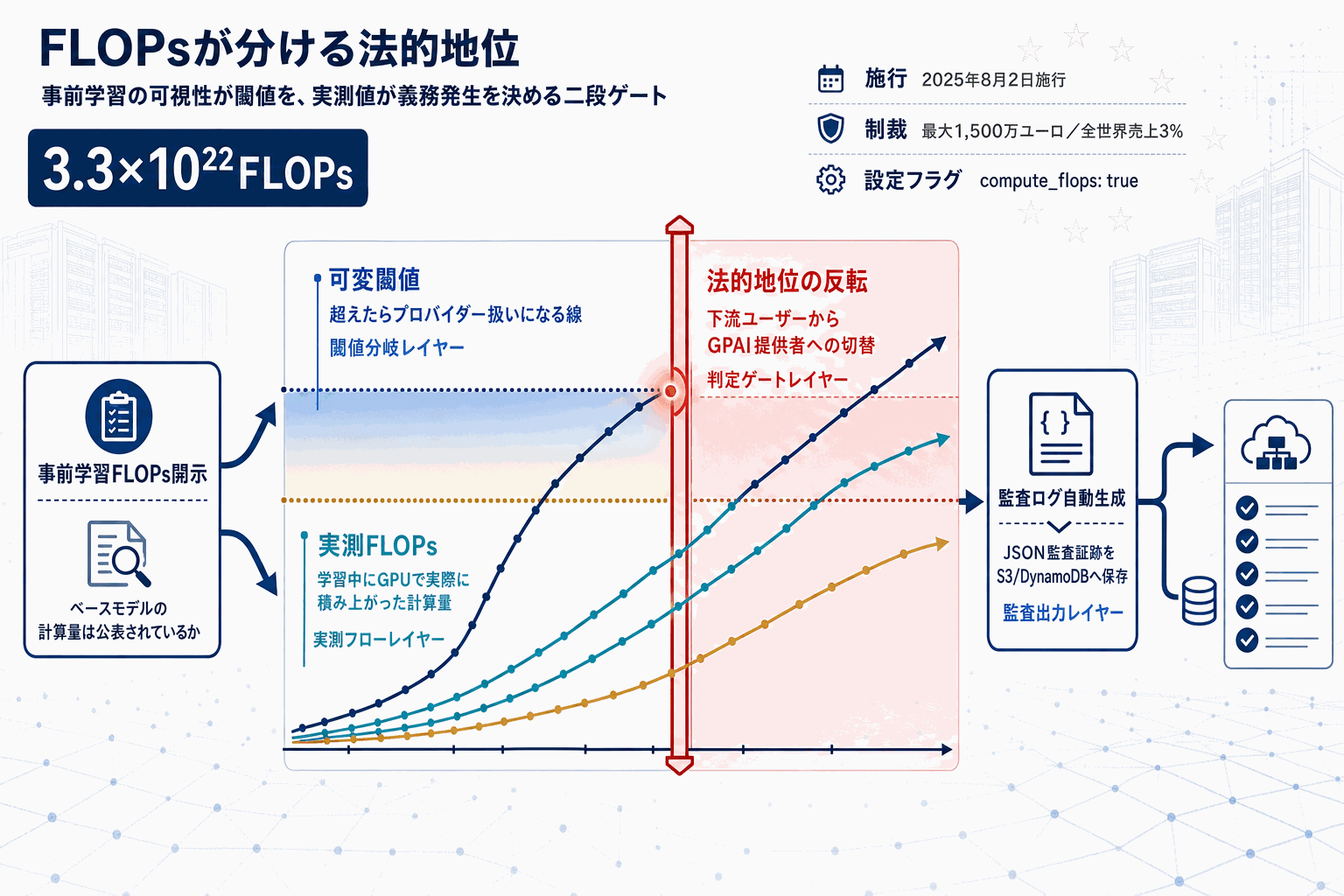

閾値の判定は事前学習FLOPsに依存する。ベースモデルの事前学習FLOPsが10²³以上であれば、その3分の1がファインチューニング側の閾値となる。たとえばLlama-3-70Bは推定1.5×10²⁴ FLOPsの事前学習を経ており、ファインチューニング閾値は4.5×10²³ FLOPsとなる。一方、事前学習FLOPsが不明または10²³未満の場合、デフォルト閾値として3.3×10²² FLOPsが適用される。多くのオープンモデルは事前学習FLOPsを明示しておらず、このデフォルト閾値が事実上の基準となるケースが多い。

AWSが公開したFine-Tuning FLOPs Meterは、SageMaker AI上のトレーニングジョブにおいてLoRA、Spectrum、フルファインチューニングの3方式に対応してFLOPsを実測する。NVMLを通じてGPUハードウェアレベルの監視も行い、結果はJSON形式の監査用ドキュメントとして自動生成され、Amazon S3またはDynamoDBへ保存できる。設定フラグ1つで有効化できるため、既存パイプラインへの組み込み負荷が低い点が特徴だ。

日本企業にとっての含意は明確で、EU域内に提供するLLMをファインチューニングする場合、GPAI義務該当の有無を客観的なFLOPs計測値で示せるようになる。規制対応を独自実装する負担が減り、監査対応のドキュメント整備コストも下がる。