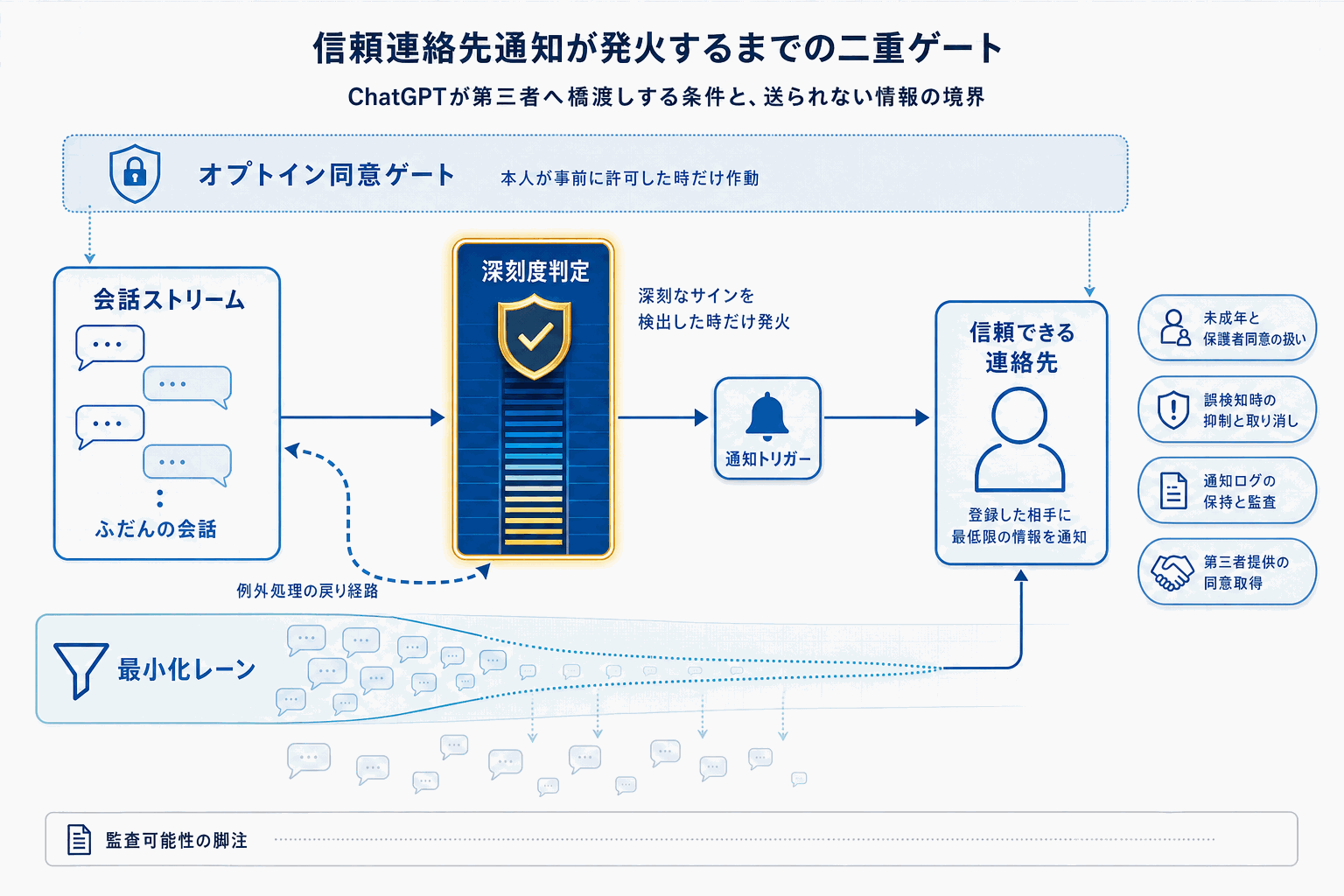

OpenAIは2026年5月7日、ChatGPTに「Trusted Contact」と呼ばれるオプション機能を導入したと公式に発表した。これはユーザーが事前に信頼できる連絡先を登録しておき、会話の中で深刻な自傷懸念が検出された場合にその連絡先へ通知が送られる仕組みである。

機能の最大の特徴は「オプトイン」である点だ。ユーザーが自ら設定しない限り作動せず、プライバシーと安全性のバランスを本人の選択に委ねる設計になっている。AIアシスタントがメンタルヘルス領域に踏み込む際の典型的な論点——監視か支援か、介入か自律尊重か——に対し、OpenAIは「本人の事前同意を前提に第三者へ橋渡しする」という解を示した形になる。

日本の読者にとっての含意は二つある。第一に、教育現場や医療・福祉領域でAIチャットボットを導入する際、危機検出と外部通知のフローをどう設計するかという具体的な参照例ができたこと。第二に、国内サービス事業者が同種機能を実装する場合、個人情報保護法における第三者提供の同意取得、未成年の場合の保護者同意、誤検知時の責任分界といった論点を具体的に設計する必要が生じることだ。

一方で、本発表のみでは検出アルゴリズムの精度、通知が発動する具体的閾値、連絡先側がどのような情報を受け取るかといった詳細は限定的である。実装判断を行う立場の読者は、公式ドキュメントの追加情報を継続して確認し、自社プロダクトの安全設計に反映する際の条件整理を進めることが求められる。