EMOは、Allen Institute for AIが公開したMoE(Mixture of Experts)モデルで、総パラメータ14B・アクティブ1B、128エキスパート中8エキスパートを起動する構成を取る。特徴は、事前学習中にモジュール構造が自律的に出現するよう設計されている点にある。

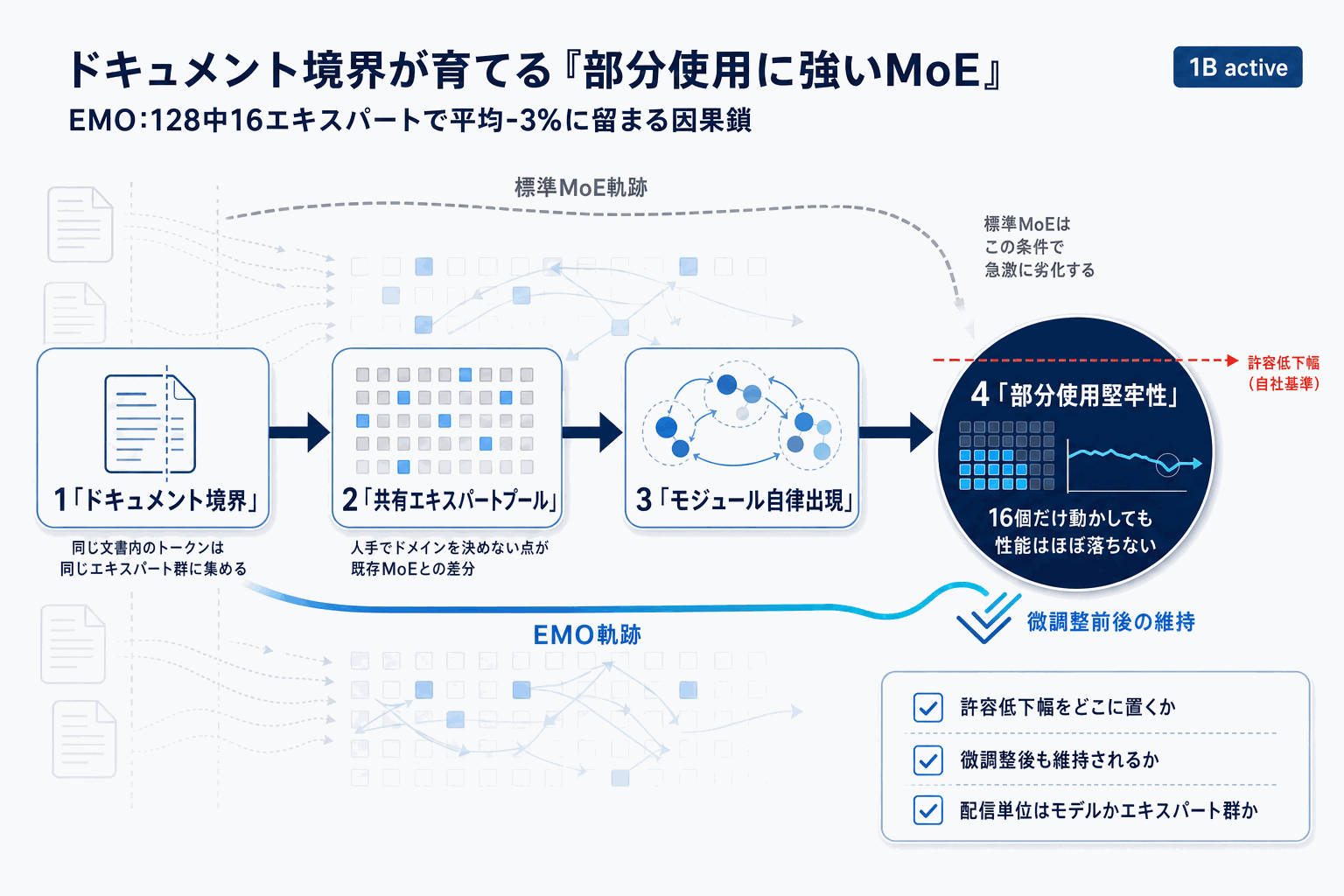

具体的には、ドキュメント境界を弱い教師信号として利用し、同一ドキュメント内のトークンを共有エキスパートプールに制約する。これにより、人手でドメインを定義しなくても、関連するトークン群が同じエキスパート群に集まるモジュール構造が立ち上がる。さらにグローバル・ロードバランシングを併用することで、ドキュメント内での一貫したエキスパート使用と、モデル全体でのエキスパート分散を両立させている。

実用上の注目点は、エキスパートの部分使用に対する堅牢性である。標準的なMoEでは、推論時にエキスパートのサブセットだけを使うと性能が急激に劣化するのに対し、EMOは128エキスパート中16個(12.5%)だけを使った条件でも、全ベンチマーク平均で約3%の低下に留まる。この堅牢性は微調整の前後いずれでも維持されるとされる。

読者にとっての含意は明確だ。フロンティアモデルが兆パラメータ規模に向かう一方で、実際の運用ではメモリと推論コストが制約になる。EMOの設計は、必要なエキスパートだけを選択的に使う展開を性能低下を抑えて実現する道筋を示しており、エッジ・オンプレ環境や特化型サービスでの検証対象になる。実装コードとモデルは公開されており、自社ワークロードでの再現実験に入れる段階にある。