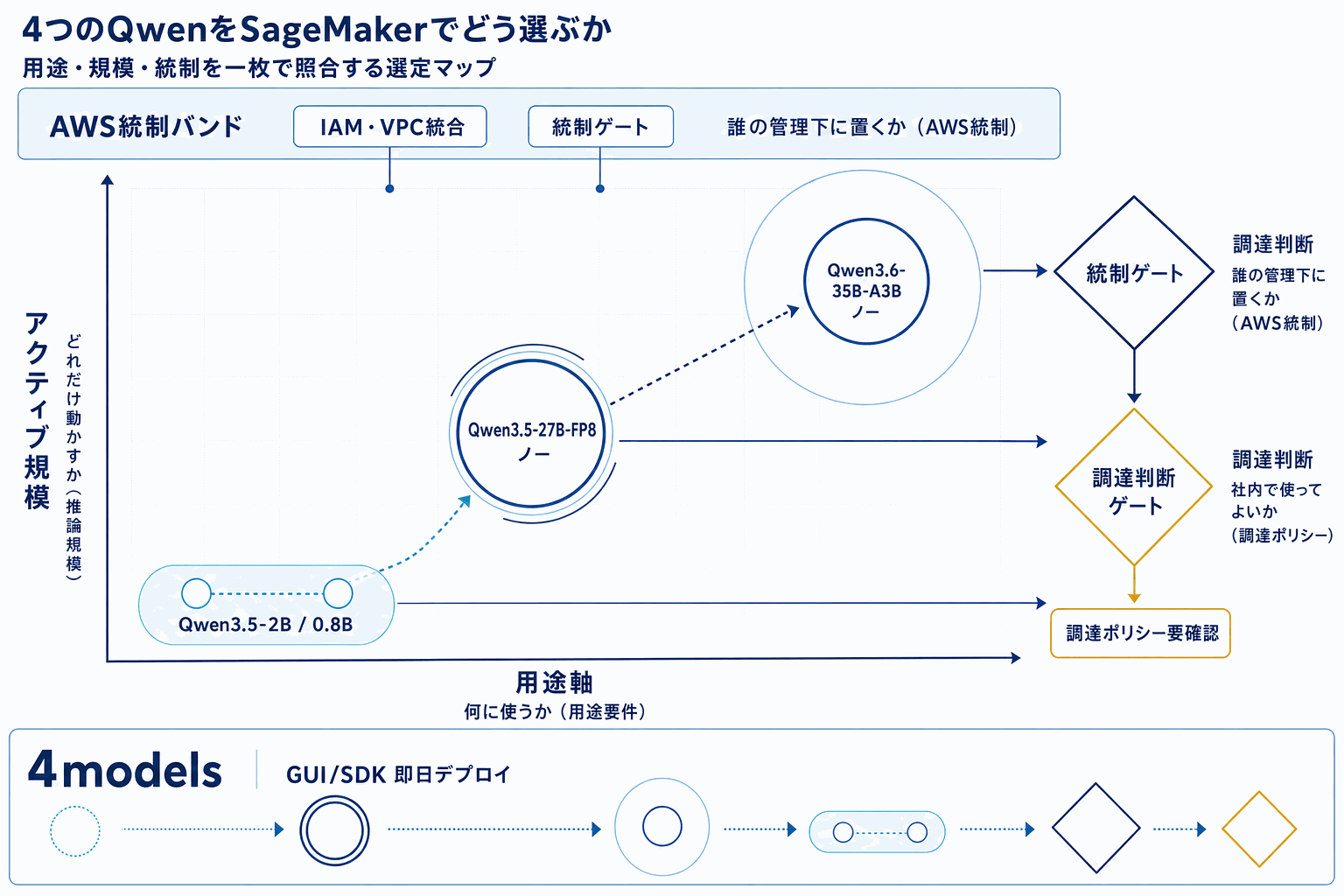

AWSは2026年5月5日、Amazon SageMaker JumpStartで4つのQwenモデルの提供を開始した。ラインナップはマルチモーダル推論向けのQwen3.5-27B-FP8、コーディングエージェント向けのQwen3.6-35B-A3B、軽量用途のQwen3.5-0.8BとQwen3.5-2Bの4種類で、SageMaker StudioのGUIまたはSageMaker Python SDKから即日デプロイできる。

Qwen3.5-27B-FP8は画像・動画・テキストを横断する視覚言語モデルで、200言語以上の多言語コミュニケーションと最大100万トークンの長文脈処理に対応する。エージェントのツール利用、コーディング支援、数学的推論といった複合タスクが想定用途として挙げられている。FP8量子化により、27BクラスながらGPUメモリ要件が抑えられる点が実装者にとっての利点になる。

Qwen3.6-35B-A3Bは総パラメータ35Bに対し推論時のアクティブパラメータが3BというMixture-of-Experts構成で、フロントエンド開発、リポジトリ規模のコード推論、マルチステップのエージェント対話、コーディングCopilot用途に最適化されている。アクティブパラメータが小さいため、同等精度帯の密結合モデルよりも推論コストを抑えやすい。

一方、Qwen3.5-0.8Bと2Bはプロトタイピング、ファインチューニング、オンデバイス推論、エッジ展開を想定した軽量マルチモーダルモデルで、計算資源が限られる環境でも多言語テキスト生成や視覚理解を扱える。

日本の開発現場にとっては、SageMakerの既存のIAM・VPC・監査ログの枠組み内でQwen系を試せる点が意思決定の焦点になる。中国発モデルの採用可否は各社の調達ポリシーに依存するため、技術検証と並行して利用規約とデータフローの確認を進めることが実装の前提となる。