OpenAIは2026年5月4日、リアルタイム音声AIを支えるWebRTCスタックをゼロから再構築したことを公式ブログで明らかにした。目的は3点に集約される。ひとつ目は低遅延、ふたつ目はグローバルスケールでの安定提供、みっつ目は人間同士の会話に近い自然なターンテイキングの実現である。

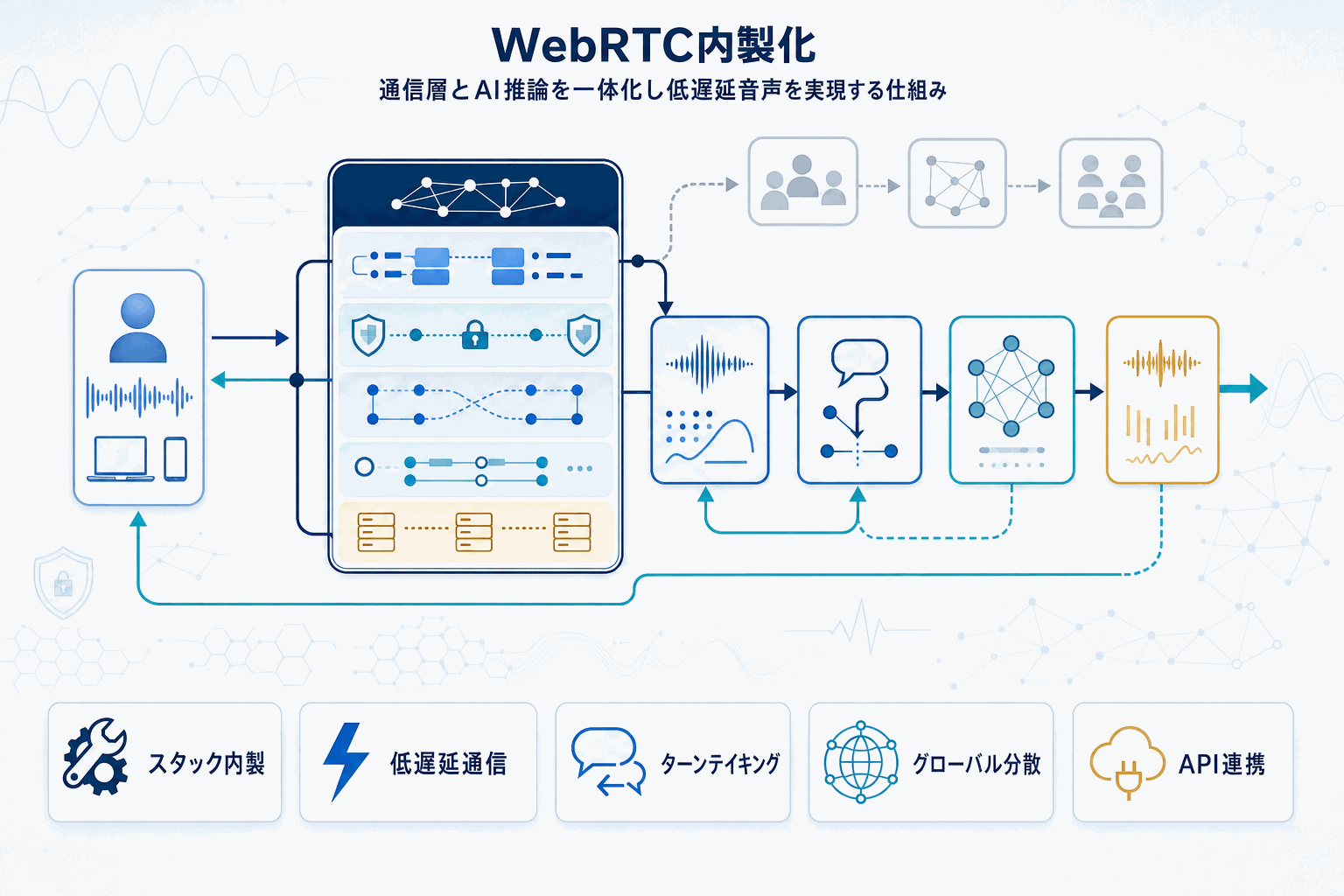

WebRTC自体はW3CとIETFで標準化されたブラウザ向けリアルタイム通信技術で、本来はビデオ会議やP2P通話を想定して設計されてきた。音声AIの用途では、ユーザーの発話検出、LLM側の応答生成、割り込み処理、音声合成の再生といった複数の処理を通信層と密に連動させる必要があり、汎用WebRTCスタックのままでは最適化の余地が大きい。OpenAIが自前で作り直したのは、この統合最適化を通信レイヤまで踏み込んで行うためだと位置付けられる。

開発者にとっての実務的影響は明確だ。OpenAIのRealtime APIはWebRTCとWebSocketの両方の接続方式を提供しており、ブラウザやモバイルからの直接接続にはWebRTC経路が推奨される。今回の刷新はその推奨経路の品質そのものを引き上げる。加えてMicrosoftのAzure AI Foundryからも同じRealtime Audio APIがWebRTC経由で利用できるため、日本企業が既存のMicrosoft調達ルートで音声AIを組み込むシナリオがそのまま強化される。

一方で、LiveKitやAgoraなど汎用リアルタイム通信基盤とOpenAIを組み合わせて使ってきた構成や、自前でWebRTCを運用してきたチームにとっては、比較対象がアップデートされたことを意味する。音声エージェント、コンタクトセンター自動化、音声UI搭載アプリを手掛ける組織は、自社構成の遅延・中断耐性・コストをこの新しい基準線で測り直す局面に入った。