Luma Labsが公開した「Camera Motion Concepts」は、Ray2向けに提供される初の学習可能なカメラモーション制御機能群である。公式changelogによれば、最小限のトレーニング例から信頼性の高い、そして組み合わせ可能なカメラ動作を実現する点が設計思想の中心に据えられている。

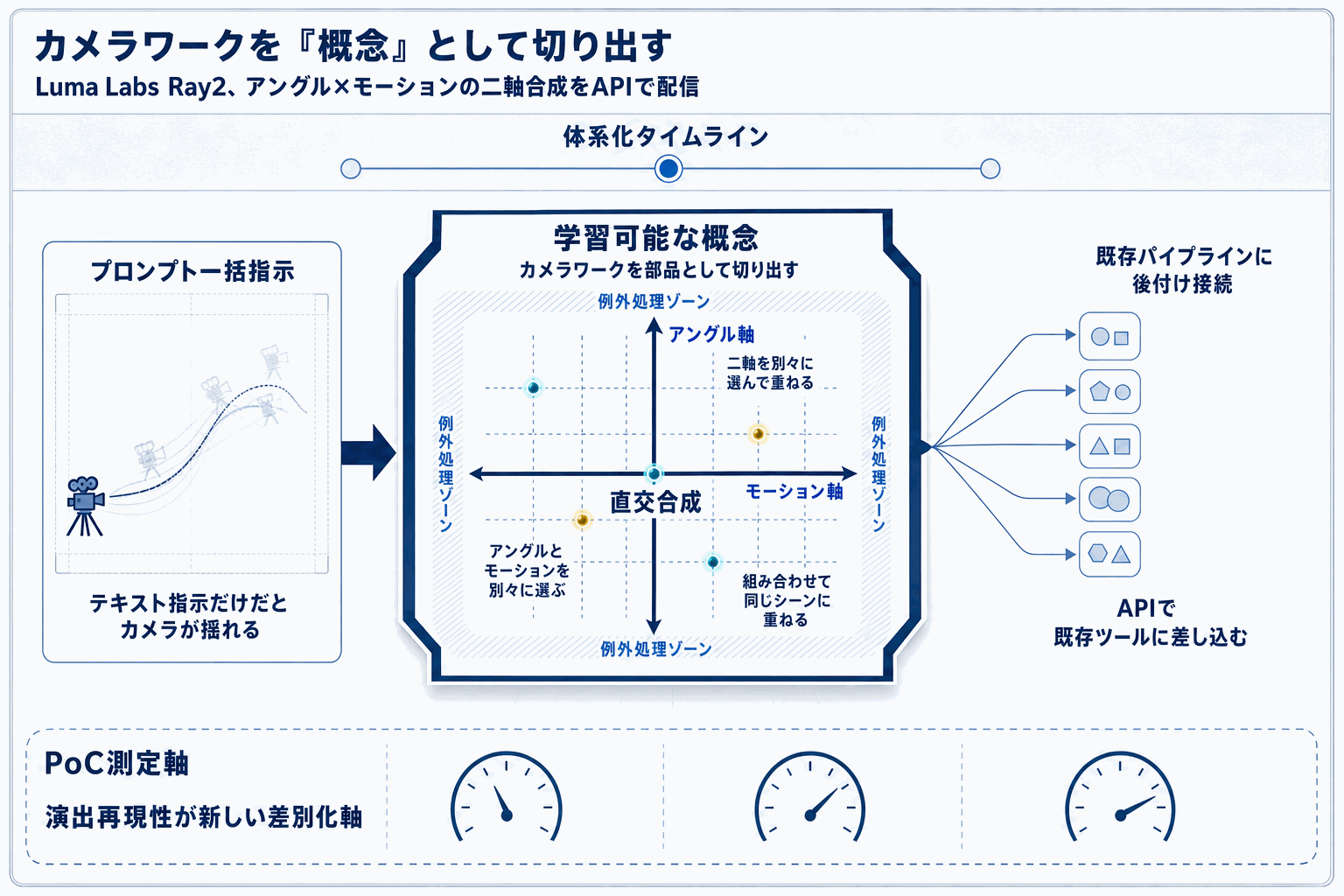

背景として、AI動画生成では「自然な動き」の再現が進む一方、監督が指示する具体的なカメラワーク(ドリーイン、パン、トラッキングなど)をプロンプトで安定して再現することが長年の課題だった。Lumaは2025年4月に9種類の映画的フレーミングを扱う「Camera Angle Concepts」を先行公開しており、今回のMotion Conceptsと合わせて「アングル×モーション」の2軸で演出を組み立てられる体系が整った形となる。

Ray2自体はRay1比10倍の計算リソースを投じたマルチモーダルアーキテクチャで構築されており、AWS Bedrock、fal、Replicate、AI/ML APIなど複数の提供経路を持つ。Camera Concepts APIはこれらの既存パイプラインに組み込めるため、日本の映像制作会社や受託開発者にとっては、自社SaaSや社内ツールに「再現性のあるカメラワーク」を後付けで組み込める実装オプションが増えたことになる。

実装着手時の落とし穴として、Conceptsはあくまで学習済みの概念を呼び出す仕組みであり、未対応のカメラワークはプロンプトでの補完が必要になる点、複数Conceptsの組み合わせ時に優先順位や相互作用の検証が必要な点は、PoC段階で測っておきたい。競合のSoraやRunwayと比較する際は、生成品質だけでなく「指定したカメラワークの再現率」を評価指標に加えることで、用途適合性を判断しやすくなる。