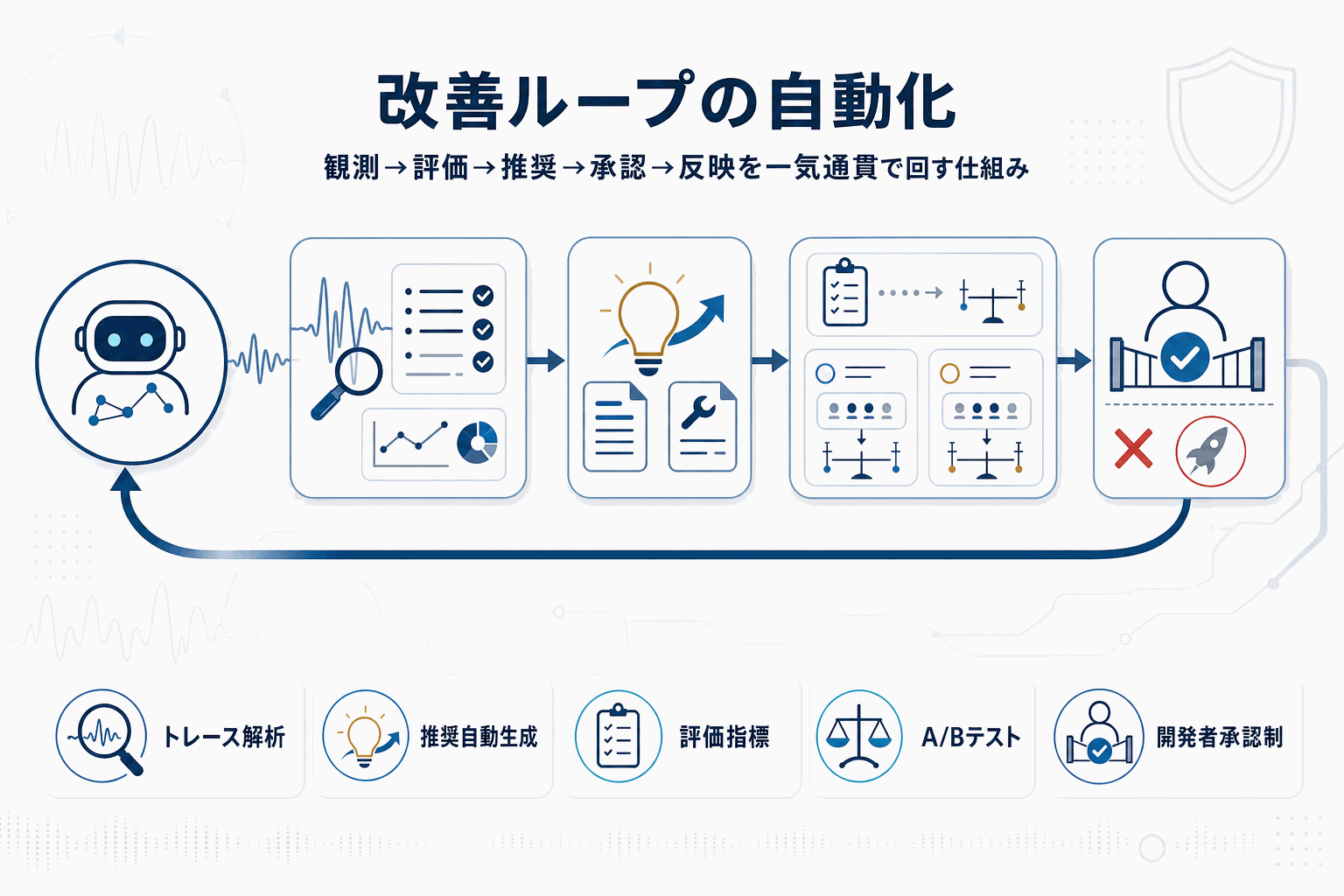

Amazon Bedrock AgentCoreは、AIエージェントを本番運用するための基盤で、これまで観測(Observability)と評価(Evaluations)の機能を提供してきた。今回プレビュー公開された最適化機能は、評価で見えた課題を「具体的な改善案」として提示し、その効果を検証するまでを自動化するものだ。

中核は3つの機能で構成される。第一に推奨事項の生成で、プロダクションのトレースとAgentCoreが出力する評価結果を入力に、ワークロードに最適化されたシステムプロンプトとツール説明を自動生成する。第二にバッチ評価で、事前定義したテストケースに対して推奨内容を検証する。第三にA/Bテストで、事前定義テストセットまたはライブの本番トラフィックを使い、変更を本番に出す前に統計的有意性を報告する。

設計上重要なのは、すべての推奨が開発者の承認を経てから本番に適用される点だ。自動デプロイは行われず、変更の責任は開発者側に残る。モデルの更新やユーザー行動の変化でエージェント品質が静かに劣化する問題に対し、改善提案から検証までを機械化しつつ、最終判断と監査可能性を人側に残す構成となっている。

提供範囲はAgentCore Evaluationsが利用可能な全AWSリージョンで、既存ユーザーは追加のセットアップなしでプレビューを試せる。独立系のLLMOps・評価基盤ツールと機能領域が重なるため、AWS中心にエージェントを構築している組織では評価基盤の選定判断を見直すタイミングになる。