AWSは2026年5月7日、Amazon EC2 P6-B300インスタンスを米国東部(バージニア北部)リージョンで提供開始したと発表した。P6-B300はNVIDIA Blackwell Ultra GPUを8基搭載し、GPUメモリ合計2.1TB、システムメモリ4TB、EFAネットワーキング6.4Tbps、ENA専用スループット300Gbpsという構成を持つ。

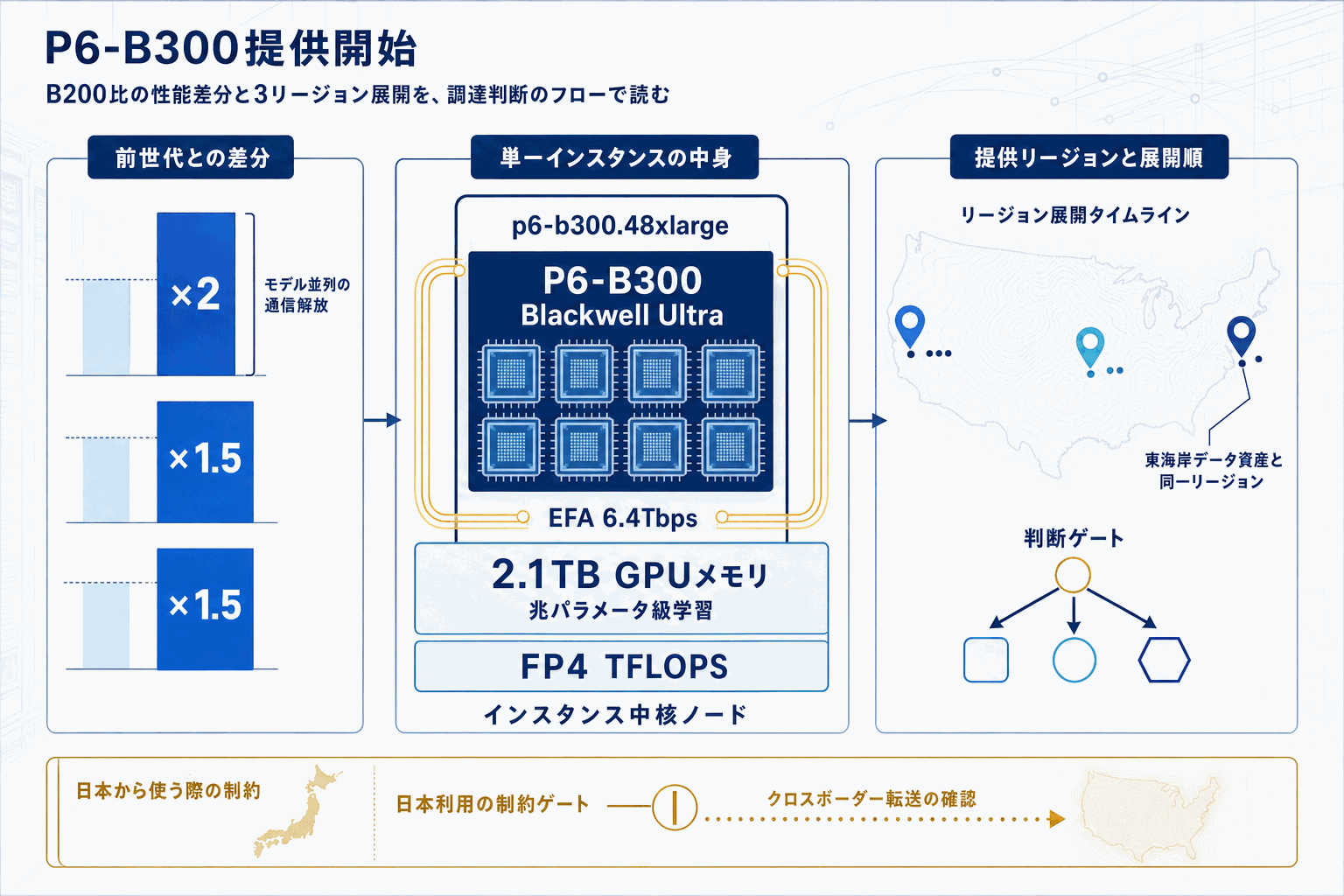

前世代のP6-B200との比較では、ネットワーク帯域が2倍、GPUメモリサイズが1.5倍、FP4(スパース性なし)でのGPU TFLOPSが1.5倍になる。AWSはこの構成を、兆パラメータ規模の基盤モデル(FM)や大規模言語モデル(LLM)の学習・デプロイ用途に位置付けており、ネットワークとメモリの拡張により学習時間の短縮とトークンスループットの向上が得られるとしている。

提供サイズはp6-b300.48xlargeのみで、リージョンは米国西部(オレゴン)、AWS GovCloud(US-East)、米国東部(バージニア北部)の3拠点となる。バージニア北部はAWSで最も多くのサービスが集中する主要リージョンであり、既存のS3バケットやデータレイクと同一リージョンで最上位GPUを確保できる点が、東海岸を拠点とするAI開発組織にとっての実務的な差分となる。

一方、日本の東京・大阪リージョンでの提供は今回の発表に含まれていない。国内企業が活用する場合はクロスリージョンでのデータ転送とレイテンシを前提とする構成になるため、日本への直接影響は限定的となる。国内で兆パラメータ級の学習基盤を必要とする組織は、リージョン展開の続報を確認しつつ、B200世代との性能・コスト比較を通じて調達計画を更新する必要がある。