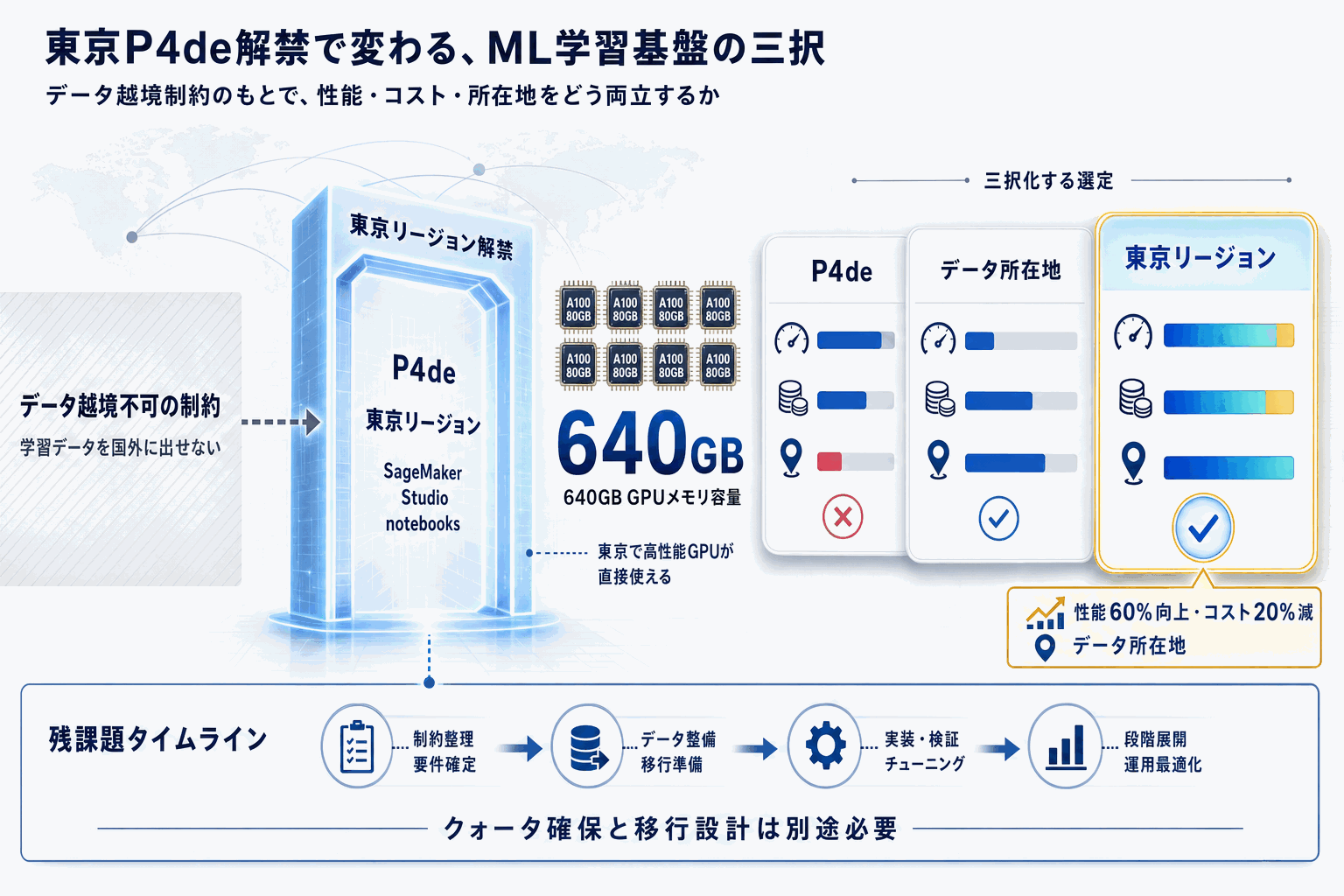

AWSは、SageMaker Studio notebooksにおけるAmazon EC2 P4deインスタンスの提供リージョンを、アジアパシフィック(東京・シンガポール)およびヨーロッパ(フランクフルト)に拡大したと発表した。P4deはNVIDIA A100 GPU(80GB HBM2e)を8基搭載し、合計640GBのGPUメモリを備える。これは現行P4dインスタンスのGPUメモリ容量の2倍にあたる。

AWSの公式情報によると、P4deはP4d比で最大60%のML学習性能向上と、20%の学習コスト削減を実現する。GPUメモリの増加は、高解像度データを含む大規模データセットでの学習に直接寄与する。

日本の意思決定者にとって重要なのは、東京リージョンでの一般提供という点である。生成AIや大規模モデルの社内学習において、これまで「学習データを海外リージョンに置けない」という制約から、米国リージョンのP4d/P4deを使えず、性能の劣る国内GPUインスタンスで妥協するか、オンプレGPUを調達するかの二択を迫られていたケースで、東京リージョンのP4deが第3の選択肢として加わる。

一方、コスト効果を実際に得るには、東京リージョンでのP4deクォータ確保、既存学習パイプラインの移行、Spot/On-Demandの使い分け設計といった実装課題が残る。公開ベンチマーク数値はAWS提示の最大値であり、自社ワークロードでの再現性は別途検証が必要となる。価格情報はAWSのEC2料金ページで確認できる。