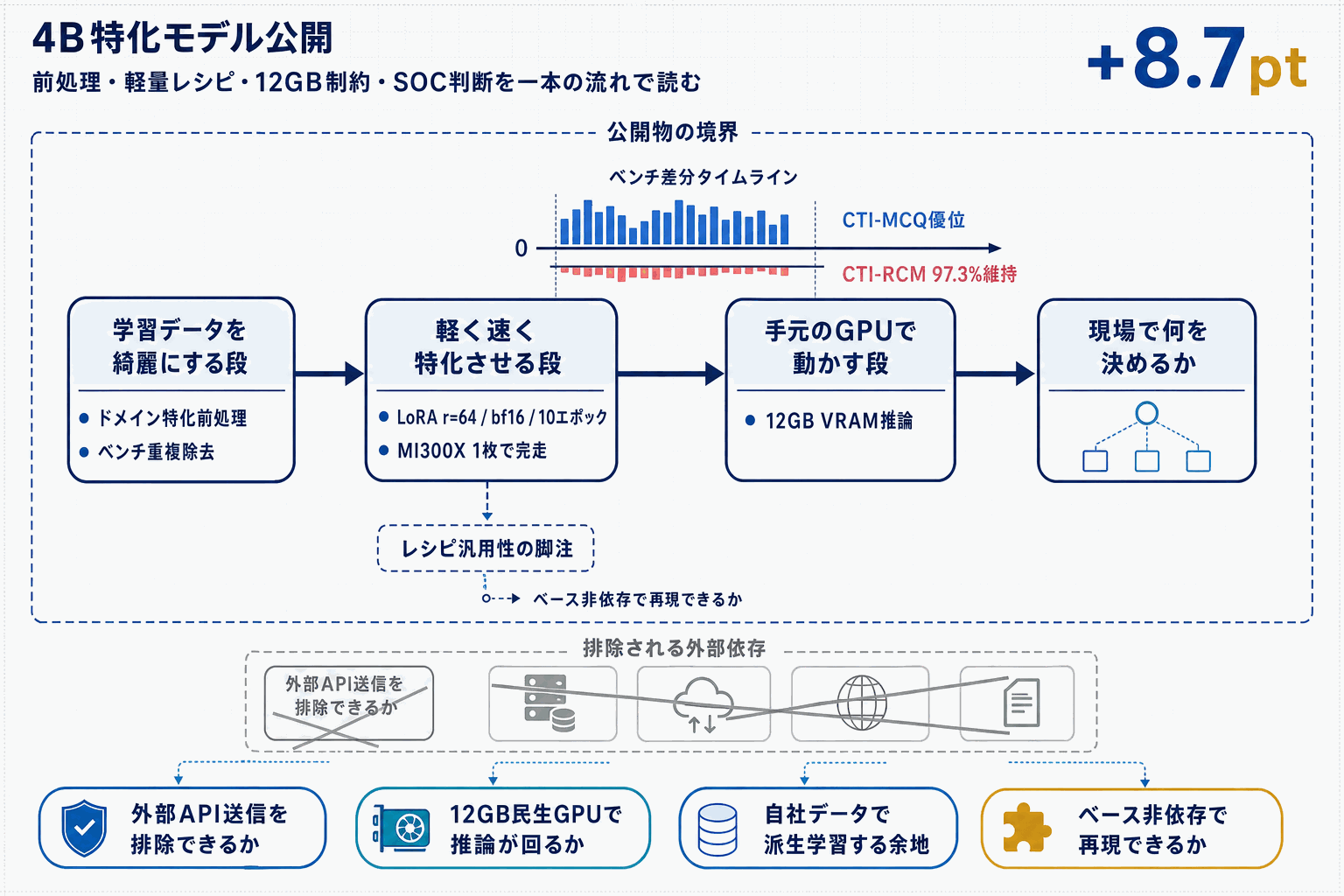

CyberSecQwen-4BはQwenベースの4Bパラメータモデルに、MITRE/NVD由来の2021年CVE→CWEマッピングと合成Q&Aを組み合わせ、CTI-Benchとの重複を除去したデータで特化学習した成果物として公開された。学習はAMD Instinct MI300X 192GB 1枚でbf16・FlashAttention-2・LoRA(r=64)・10エポックという比較的軽量な構成で完結している。

評価では、2,500問のCTI-MCQで0.5868を記録し、Foundation-Sec-Instruct-8Bの0.4996を8.7ポイント上回った。CVE→CWEマッピング1,000件のCTI-RCMでは0.6664対0.6850と1.9ポイント下回るものの、8Bモデルの97.3%の水準を4Bで保持している。同じレシピをGemma-4-E2B-itに適用したGemma4Defense-2BでもCTI-RCMで0.9ポイント差に収束し、レシピがベースモデル非依存で機能したことが示された。

読者にとっての含意は3点に整理できる。第一に、12GB VRAMの民生GPUで動く4BモデルがCTI主要ベンチで8B専門モデルに並び、場合によっては上回るため、オンプレミスやエアギャップ環境を前提とするSOC運用の選択肢が広がる。第二に、モデル・学習コード・データセットがすべてApache 2.0で公開されており、自社の脅威情報を外に出さずに派生モデルを学習する参照実装として利用できる。第三に、MI300X 1枚で完走する学習コストが明示されたことで、社内GPU予算と効果のトレードオフを具体的な数字で議論できるようになった。