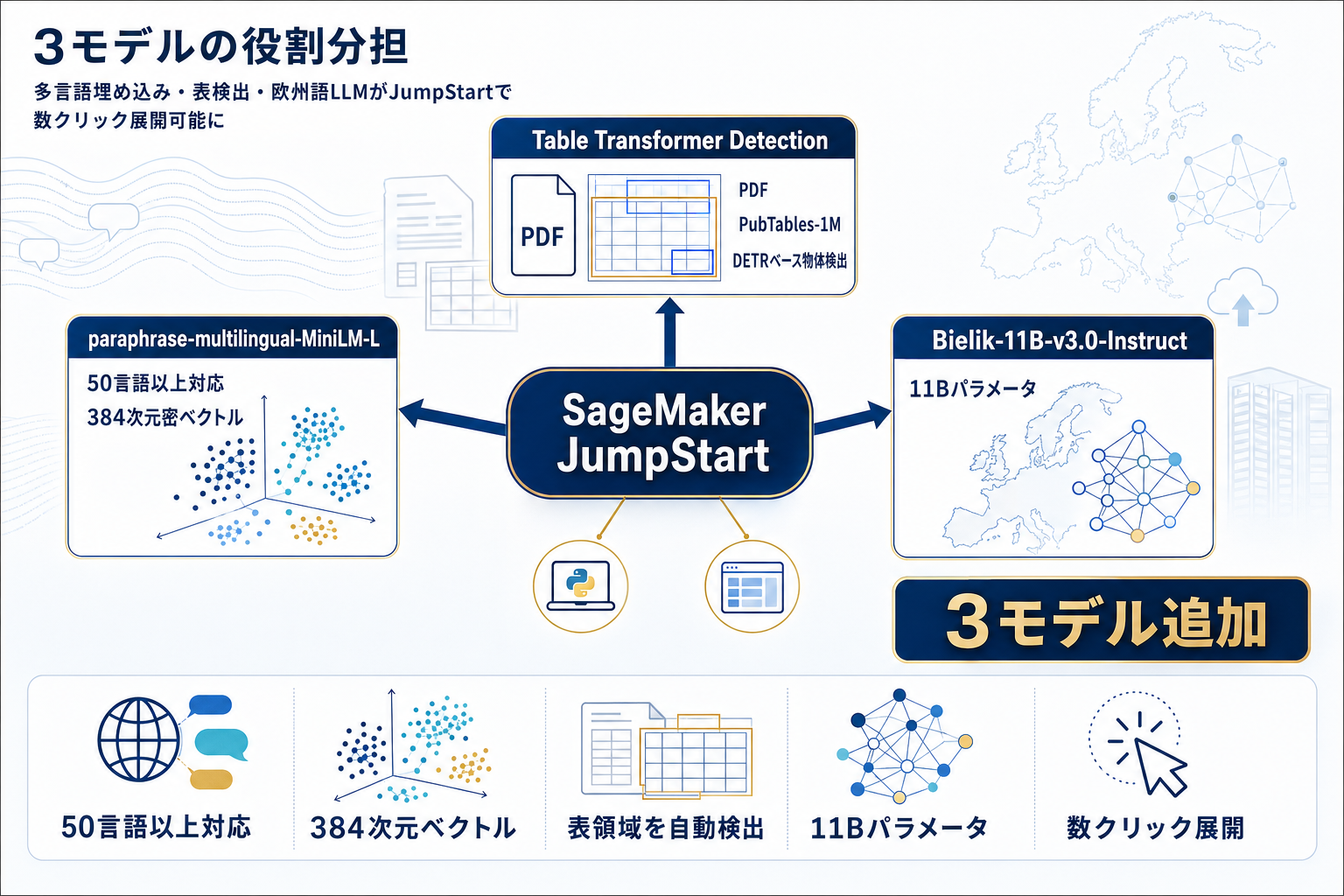

AWSは2026年4月30日、Amazon SageMaker JumpStartに3つの基盤モデルを追加した。

1つ目のparaphrase-multilingual-MiniLM-L12-v2はSentence Transformers製の軽量モデルで、50以上の言語の文・段落を384次元の密ベクトル空間にマッピングする。言語別設定なしでクロスリンガル意味検索、多言語文書クラスタリング、文類似度スコアリングに対応し、RAGやナレッジ検索の土台になる。

2つ目のMicrosoft Table Transformer DetectionはPubTables-1Mデータセットで学習されたDETRベースの物体検出モデルで、PDFやスキャン画像といった非構造化文書から表領域を検出する目的に特化している。研究論文や財務レポートなど大量の文書を対象にした自動データ抽出・デジタル化パイプラインに組み込める。

3つ目のBielik-11B-v3.0-InstructはSpeakLeashとACK Cyfronet AGHが開発した110億パラメータの生成LLMで、32の欧州言語にまたがる多言語コーパスで学習され、特にポーランド語に強い。欧州言語での対話、STEM・数学的推論、論理・ツール利用、深い言語理解を要するエンタープライズ用途を想定する。

3モデルともSageMaker StudioのModelsセクションまたはSageMaker Python SDKから数クリックで自社AWSアカウントにデプロイできる。日本のユーザーにとっては、多言語埋め込みと表検出の組み合わせが文書処理・RAG領域の実装を加速させる一方、Bielikはポーランド語・欧州言語案件を抱えるグローバル企業に直接的な価値を持つ。