Input Convex Neural Networks(ICNNs)は、入力に対して出力が凸になることを構造的に保証するネットワークで、最適輸送(OT)マップの学習、凸回帰、ロバスト最適化、経済学的な効用関数モデリングなど『凸性が仕様として要求される』応用で広く使われてきた。一方でICNNsは、重みの非負制約や活性化関数の制約により、深くすると学習が不安定になり、表現力と最適化のバランスが取りにくいという実務上の課題が知られていた。

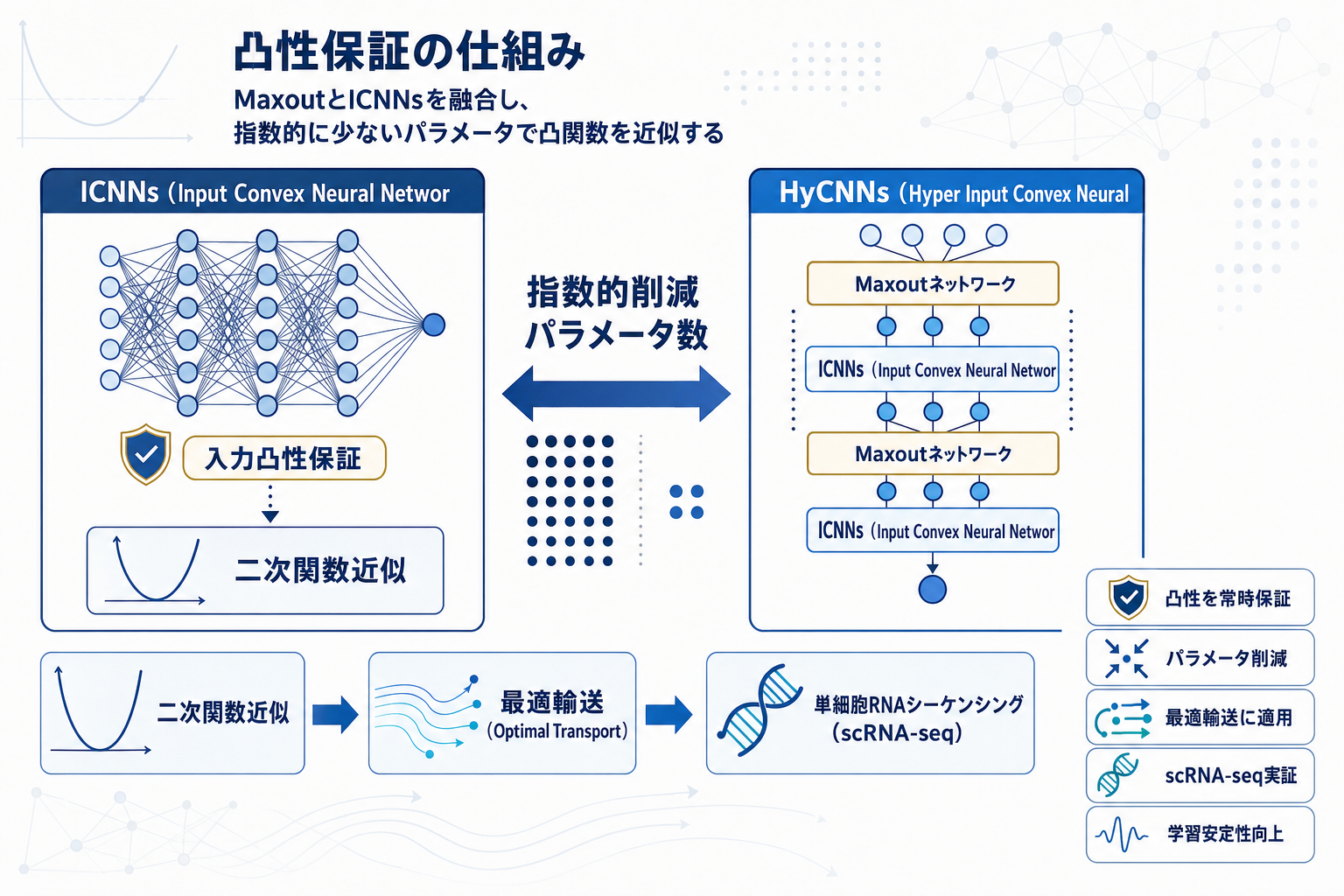

今回arXivに公開された『Hyper Input Convex Neural Networks(HyCNNs)』は、Maxoutネットワークの思想をICNNsに組み込むことで、入力凸性を常に保ちながら深さを有効活用できる設計を提案する。著者らは理論解析として、二次関数を任意精度で近似する際、HyCNNsが必要とするパラメータ数はICNNsより指数的に少ないことを証明した。これは同一精度での学習・推論コストの境界を動かす結果である。

実験面では、凸回帰・補間タスクでICNNs・MLPを上回り、さらに高次元の最適輸送マップ学習および単細胞RNAシーケンシングデータへの適用で、ICNNベースのneural optimal transport手法および各種ベースラインを多くの設定で上回ることが示されている。scRNA-seqのように細胞状態間の輸送をOTで定式化する応用では、実データでの優位性が示された意義は大きい。

論文は65ページ・13図と規模が大きく、理論・実験の両面を厚く扱っている。ICNNsを内部で利用する生成モデル・生物情報学ツールにとって、アーキテクチャ選定の比較対象として無視できない提案となる。