Hugging Faceが2026年4月23日に公開した本ガイドは、Transformers.jsをChrome拡張機能で動かす際の設計上の勘所を、実際に動作するリポジトリ(nico-martin/gemma4-browser-extension)と対で示した点に価値がある。

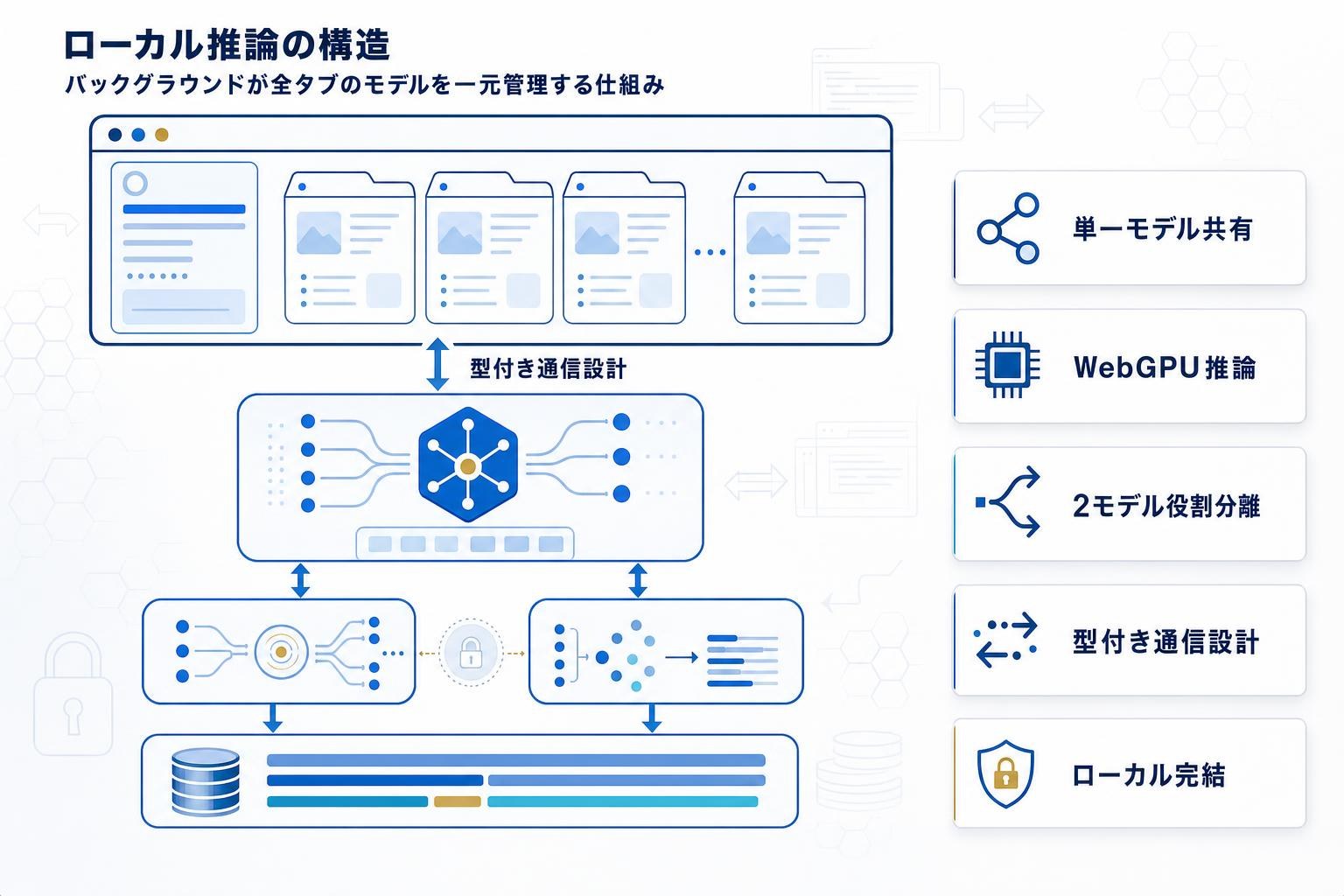

技術的なポイントは三つある。第一に、推論をすべてバックグラウンドサービスワーカー上で実行する設計だ。テキスト生成にGemma 4 E2B(q4f16量子化・WebGPU実行)、埋め込みにall-MiniLM-L6-v2(fp32)を用い、サイドパネルやコンテンツスクリプトが個別にモデルをロードする重複を避けている。第二に、モデルキャッシュを拡張機能オリジン(chrome-extension://)に置くことで、全タブ・全セッションで同じ重みを共有する。これは通常のWebページ実装では得にくい利点で、拡張機能という配布形態ならではの設計選択になる。第三に、サイドパネル・コンテンツスクリプト・バックグラウンド間の通信を型付きenumで管理し、バックグラウンドを唯一のコーディネーターに据えることで、MV3のサービスワーカーが抱えるライフサイクルの不安定さを責務分離で吸収している。

意思決定への含意は明快だ。要約・翻訳・RAG補助といった軽量タスクであれば、API課金とサーバー運用なしで拡張機能として配布できる実装根拠が、公式ドキュメントのレベルで揃った。入力テキストが外部に出ないため、社内文書や個人情報を扱うユースケースでの同意取得・越境移転の論点も回避しやすい。一方、Gemma 4 E2Bの実行にはWebGPUと相応のメモリが必要で、対応端末の分布や初回モデルDLサイズが実運用上のハードルになる。まずは公開リポジトリを動かして自端末でのロード時間とトークン速度を測り、置き換え可能な機能範囲を定義することが、次の一手になる。