AWSはSageMaker HyperPodの対応インスタンスを拡張し、NVIDIA RTX PRO 6000 Blackwell Server Edition GPUを搭載するG7eと、CPU/メモリ重視のr5d.16xlargeを追加した。HyperPodは基盤モデルの学習・デプロイ向けに、フォールトトレランス、自動クラスタ復旧、分散学習ライブラリを組み込んだマネージド基盤で、今回の追加により選択できる計算プロファイルが広がる。

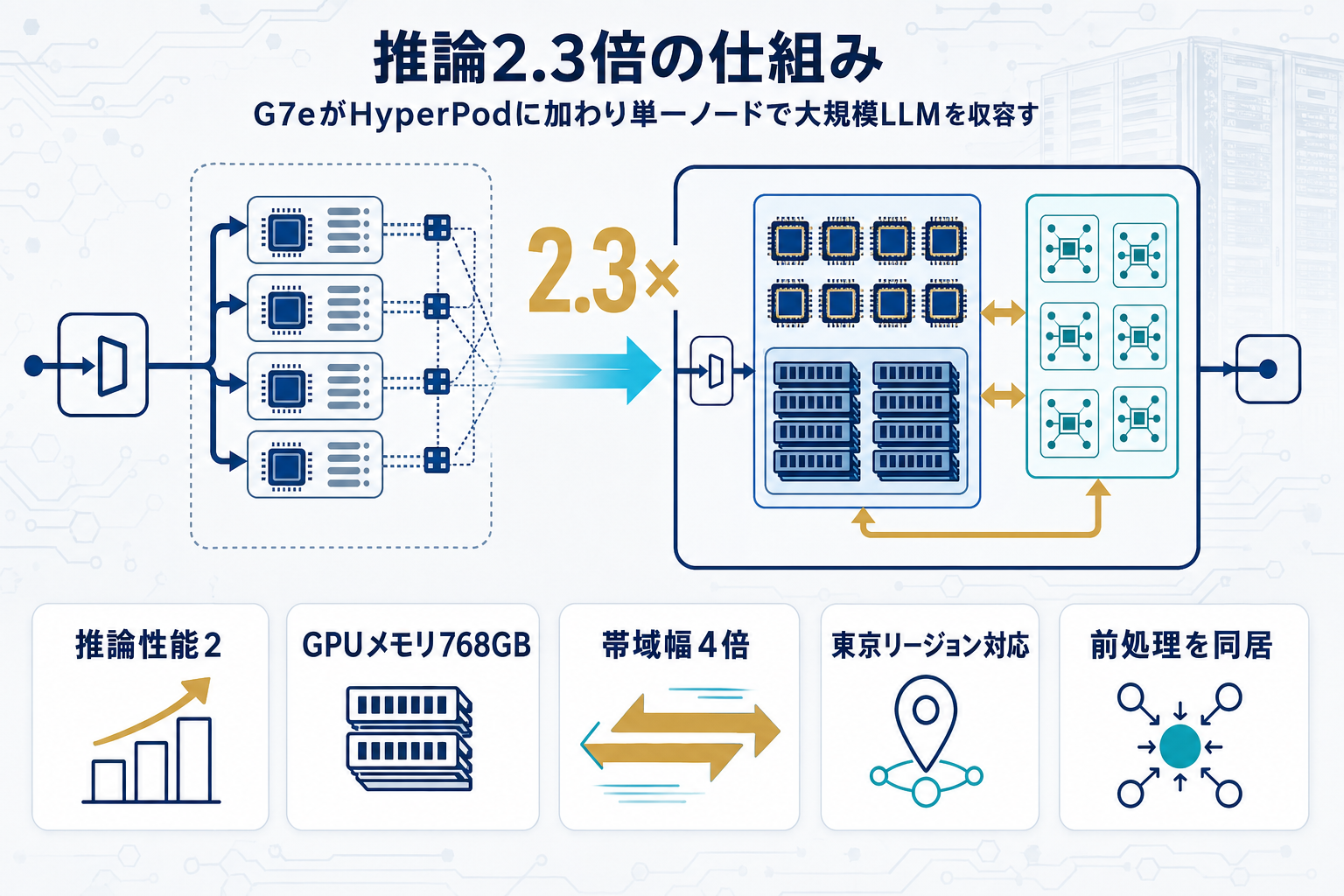

G7eの数値面の変化は明確だ。G6e比で推論性能は最大2.3倍、TFLOPsは最大1.27倍、GPU間帯域幅は最大4倍、総GPUメモリは最大768GB。AWSはユースケースとしてLLM、エージェンティックAI、マルチモーダル生成AI、physical AIを挙げており、単一エンドポイントでより大きなモデルを収容する、または複数モデルを同居させる運用が対象となる。加えて、NLP・コンピュータビジョン・小規模生成AIのシングルノード・ファインチューニングにも位置づけられている。

r5d.16xlargeは64 vCPU、512GBメモリ、5×600GB NVMe SSD、Intel Xeon Platinum 8000シリーズ(全コア持続ターボ最大3.1GHz)という構成で、Rayによる分散学習データ前処理、大規模特徴量エンジニアリング、メモリ重めのオーケストレーションをGPUノードと同じHyperPodクラスタ内で回す用途に向く。GPU前段のETLを外部基盤に出さず同居させられる点が、運用簡素化に直結する。

リージョンはG7eが米国東部(バージニア北部・オハイオ)、アジアパシフィック(東京)、米国西部(オレゴン)、r5d.16xlargeはHyperPod提供全リージョン。東京での提供は、国内データ要件を維持したまま大規模推論基盤を組む実装選択肢を直接広げる。